Содержание

Microsoft прописала в условиях использования Copilot формулировку, которая звучит неожиданно для инструмента, продвигаемого как рабочий: сервис предназначен «for entertainment purposes only» — «только для развлекательных целей».

Это выглядит как важный сдвиг не в технологиях, а в распределении ответственности. Copilot продают бизнесу как инструмент продуктивности, но юридическая оговорка заметно снижает ожидания к результату и, в случае проблем, смещает акцент на пользователя.

Что именно меняет дисклеймер Copilot

Фраза про «развлекательные цели» сама по себе не означает, что Copilot перестанет применяться в корпоративных сценариях. Она меняет рамку: если ИИ ошибся в письме клиенту, в цифрах отчёта или в фрагменте кода, риски в большей степени остаются на пользователе и компании, которая приняла этот результат.

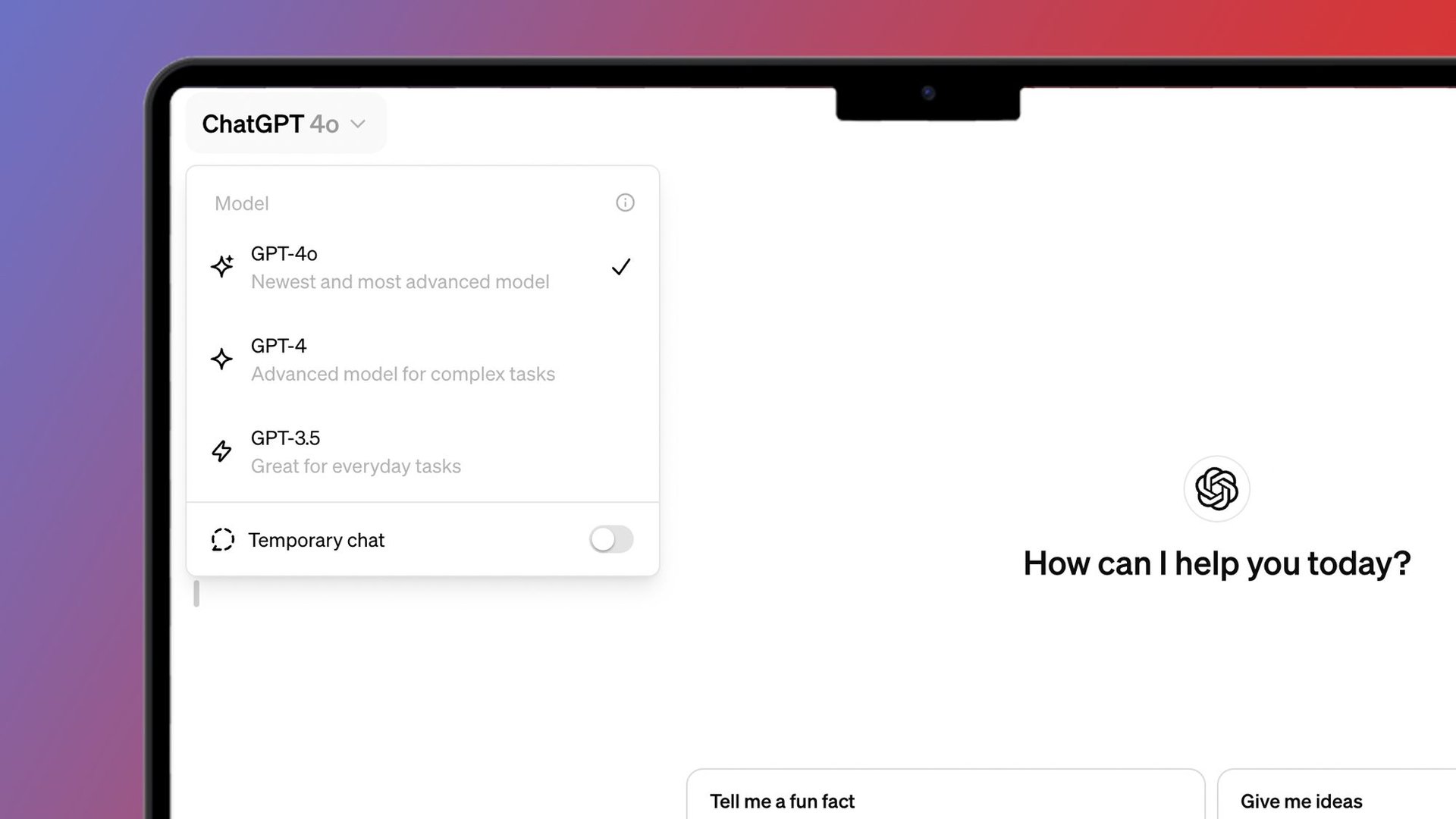

Похожие дисклеймеры встречаются не только у Microsoft — в условиях их также используют OpenAI, Google и Anthropic. Но здесь особенно заметен разрыв между тем, как инструменты продаются как «для работы», и тем, что говорит мелкий шрифт.

Такая логика уже просматривается в других сценариях: ИИ может уверенно играть роль «помощника», но ответственность за последствия часто оказывается на человеке. В этом и заключается главный вопрос — где проходит граница доверия к ассистенту, который одновременно рекламируют как рабочий стандарт и юридически описывают куда осторожнее.

Подборка недели: Muse Spark и ещё 7 AI-историй

Материал выходит в формате ICYMI — еженедельной подборки, где собраны ключевые сюжеты недели в ИИ. В подзаголовке это сформулировано прямо: «Meta’s Muse Spark and 7 other AI stories you need to catch up on». На фоне постоянного потока новостей такой формат помогает увидеть общую картину: новые модели, новая инфраструктура и, как следствие, новые поводы для споров и сомнений.

Meta тестирует Muse Spark: ставка на «встроенность»

Среди заметных тем недели — Meta’s Muse Spark. В подобных историях интерес часто смещается от абстрактной гонки «кто умнее в чате» к тому, насколько органично ИИ встраивается в привычные пользовательские действия и продукты.

Если такие интеграции становятся массовыми, выигрыш определяется не только качеством модели, но и тем, как быстро ИИ превращается в часть повседневных привычек.

Anthropic и новые опасения вокруг Claude Mythos

Отдельно упоминаются и новые опасения вокруг модели Claude Mythos, связанной с Anthropic. Важно, что в источнике речь идёт именно о появившихся вопросах и тревожных сигналах вокруг модели, без уточнений про отдельные версии или дополнительные детали.

На практике подобные поводы для беспокойства снова возвращают к теме контроля и проверки: чем активнее ИИ внедряют в рабочие процессы, тем выше цена ошибок — и тем больше внимания к ограничениям и рискам.

Профиль Сэма Альтмана и разговоры о «следующей фазе ИИ»

На неделе также фигурирует «deep and fascinating» профиль Сэма Альтмана в The New Yorker и обсуждение того, как рынок подходит к новой волне моделей и инфраструктуры. Общий фон подборки — всё более плотная связка ИИ с властью, прибылью и растущей неопределённостью.

А формулировка Microsoft про Copilot как «for entertainment purposes only» тем временем остаётся зафиксированной в официальных условиях использования — и именно это делает историю такой показательной.