Содержание

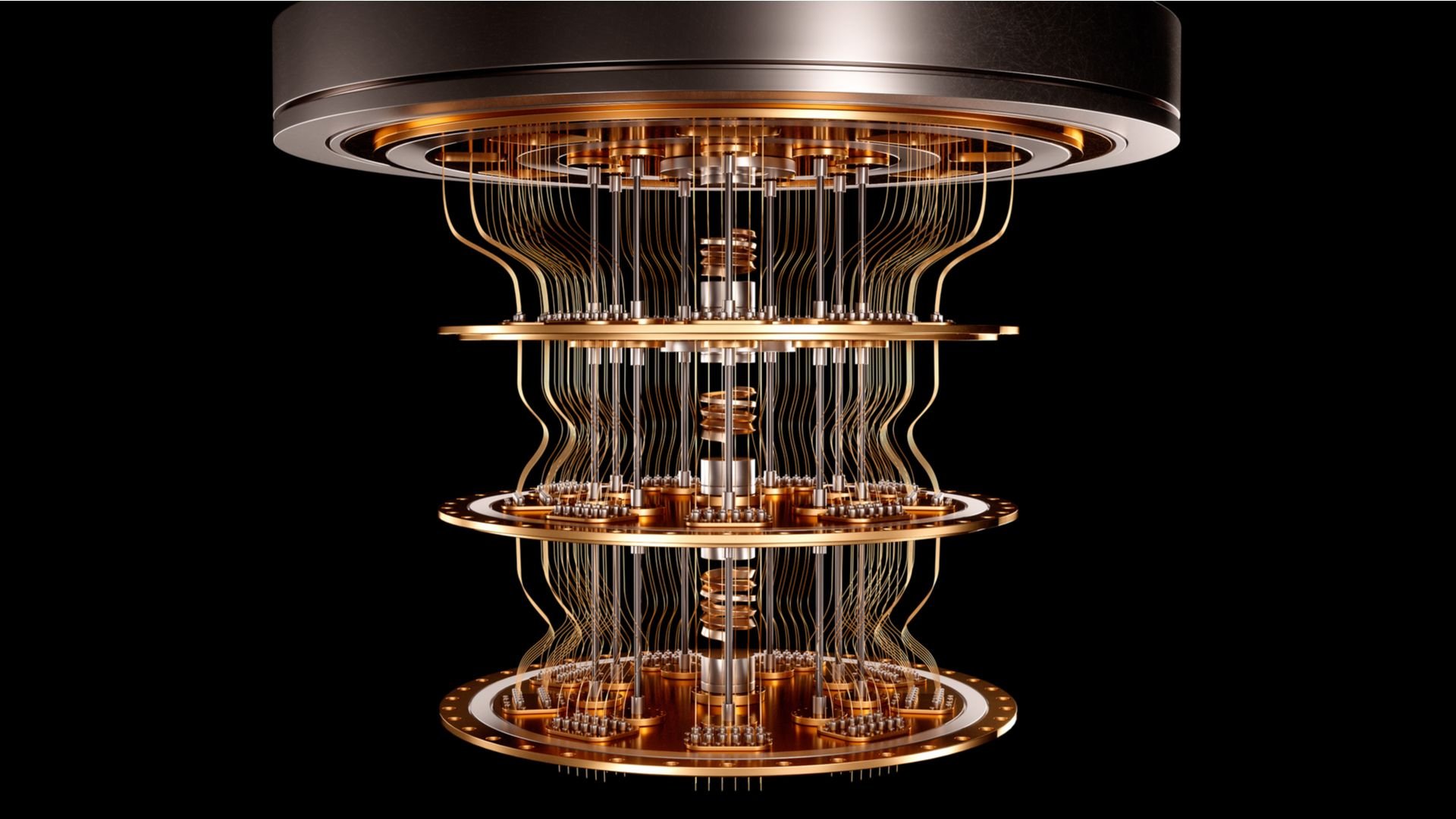

Живые нейроны крысы впервые научили выполнять вычисления для ИИ в реальном времени в замкнутом контуре. Команда из Tohoku University и Future University Hakodate натренировала культуру корковых нейронов генерировать заданные временные сигналы — от синусоид до хаотических траекторий — с помощью машинного обучения и обратной связи.

Работу опубликовали 12 марта в журнале Proceedings of the National Academy of Sciences. Исследователи считают, что такие эксперименты могут стать базой для новых интерфейсов мозг-машина и нейропротезов.

Как устроили «живой» reservoir computing и почему без микрофлюидики он не учился

Система опирается на идею reservoir computing: сложная динамика сети выступает «резервуаром», а обучаемым остаётся только простой декодер. Здесь резервуаром стали живые нейроны, которые подключили к высокоплотному массиву микроэлектродов на 26 400 каналов с шагом 17,5 мкм.

Сигналы спайков снимали с массива, фильтровали в непрерывные ряды и подавали на линейный readout-слой. Дальше выход readout возвращали обратно в культуру как электрическую стимуляцию. Так получился замкнутый контур с циклом около 333 мс на итерацию.

Ключевым оказалось не «железо», а физическая топология сети. Исследователи использовали PDMS-микрофлюидные плёнки, чтобы ограничить, как нейроны соединяются. Без таких ограничений культура быстро превращается в плотную синхронную сеть, где клетки «стреляют» почти в унисон. В таком режиме целевые сигналы система не выучила.

Нейронные тела разместили в 128 квадратных колодцах размером примерно 100 x 100 мкм. В каждом колодце было в среднем 14,6 нейрона. Колодцы связали микроканалами в двух вариантах:

- Lattice-конфигурация: равномерные связи ближайших соседей.

- Hierarchical-конфигурация: более разреженные связи с «многоуровневой» структурой.

Обе конфигурации резко снизили попарные корреляции активности по сравнению с непаттернированной культурой: 0,11 и 0,12 против 0,45. Это увеличило «размерность» динамики сети и дало декодеру больше разнообразного сигнала для обучения.

Что нейроны научились выдавать: синусы, «квадраты» и аттрактор Лоренца

Весами readout управлял алгоритм FORCE (First-Order Reduced and Controlled Error) learning. Он оптимизировал декодер в реальном времени и снижал ошибку между выходом системы и целевой формой сигнала.

- Синусоиды: с периодами 4, 10 и 30 секунд.

- Треугольные и прямоугольные волны.

- Аттрактор Лоренца: трёхмерная хаотическая траектория.

Ту же подготовку культуры можно было переобучать на другие частоты колебаний. А при аппроксимации аттрактора Лоренца исследователи получили попарные корреляции выше 0,8 между предсказанным и целевым сигналом по всем трём измерениям во время фазы обучения.

По данным команды, lattice-сети стабильно обгоняли hierarchical по всем целевым формам. Объяснение приземлённое: более плотные межмодульные связи дали более высокие частоты спайков, и линейному декодеру стало проще «снимать» информативный сигнал.

«This work shows that living neuronal networks are not only biologically meaningful systems but may also serve as novel computational resources», — заявил профессор Hideaki Yamamoto из Research Institute of Electrical Communication при Tohoku University.

Ограничения: ошибка растёт без обучения, а задержка 330 мс режет быстрые формы

После остановки обучения качество заметно падало. В автономном режиме среднеквадратичная ошибка росла в 99% испытаний.

Ещё один узкий момент — задержка петли обратной связи. Цикл около 330 мс ограничил способность системы отслеживать быстрые изменения и «острые» формы, вроде идеального прямоугольника. Исследователи прямо пишут, что снижение задержки через специализированное железо или другие методы фильтрации расширит набор сигналов, которые сеть сможет выучить.

Статья в PNAS доступна по ссылке: Proceedings of the National Academy of Sciences (DOI).