Содержание

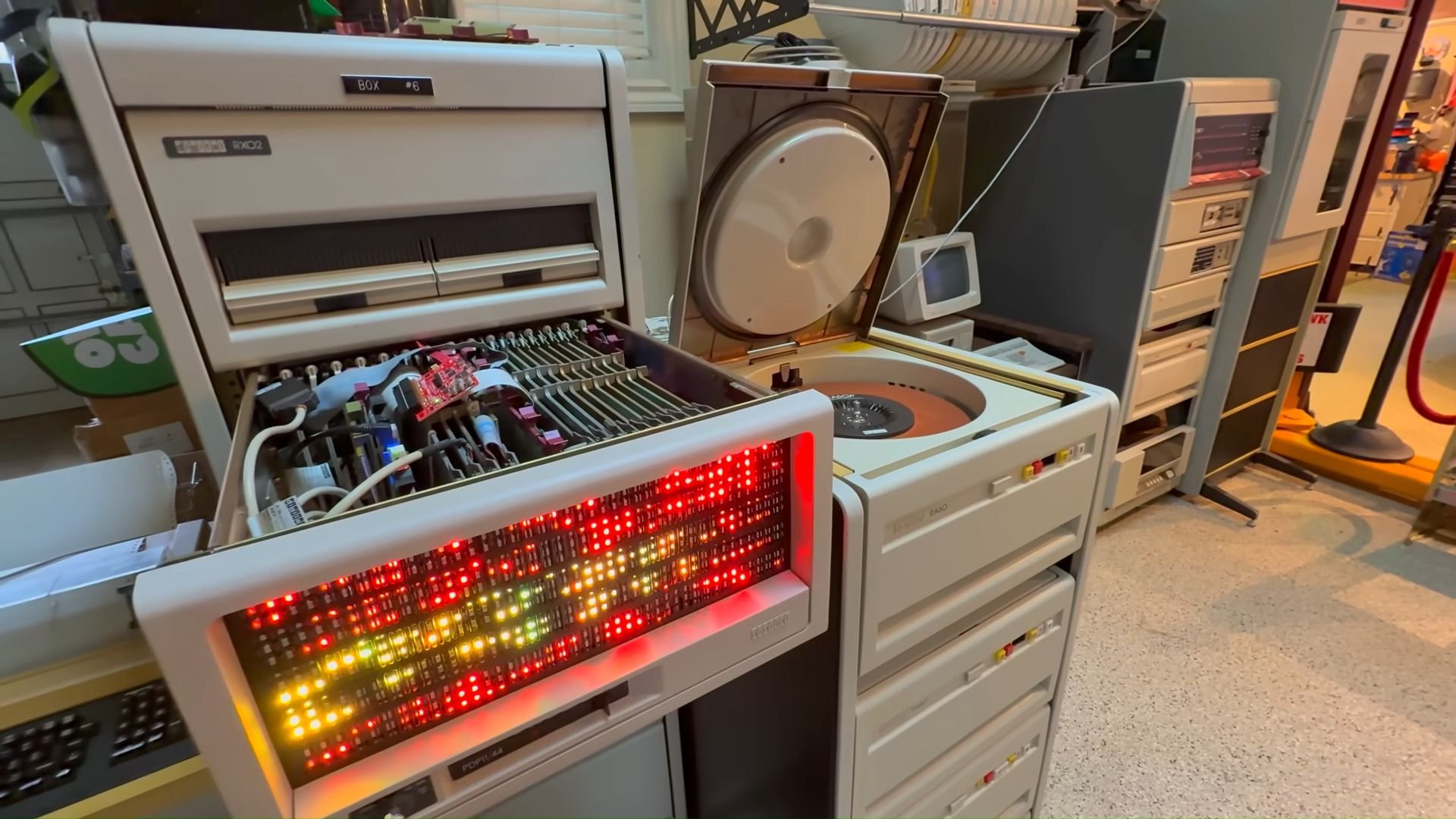

Ветеран Windows-разработки Дэйв Пламмер показал, как трансформер можно обучать на PDP-11/44 с процессором 6 МГц и всего 64 КБ оперативной памяти. Проект он называет «gloriously absurd» — и это тот случай, когда абсурд отлично объясняет, как устроено обучение нейросетей без мистики.

Демо Пламмер записал у себя в гараже. Он специально взял железо «старше большинства людей, которые спорят об AGI в интернете», чтобы показать механику обучения в максимально оголённом виде.

Attention 11: трансформер на ассемблере PDP-11

В основе эксперимента — модель Attention 11, которую написал Damien Buret. Это однослойный и одноголовый трансформер, полностью на ассемблере PDP-11. Для сегодняшнего AI-мира это почти издевательство над привычной картиной, где «нужно больше GPU», но смысл как раз в обратном: показать суть, а не масштаб.

Пламмер формулирует «грязный маленький секрет» AI прямо: обучение — это не магия. Это повторение одной и той же операции, где машина обновляет веса связей, чтобы следующий ответ был чуть менее ошибочным. В его формулировке: «It’s not AI magic. It is the machine repeatedly updating the strength of thousands of little weighted links so that the next answer will be slightly less wrong than the last one».

Под капотом всё максимально экономно. Модель держится в рамках ограничений PDP-11 за счёт фиксированной точки, урезанной точности и жёсткой оптимизации каждого цикла, чтобы обучение не растянулось «до тепловой смерти Вселенной».

- Число параметров: 1 216

- Математика: fixed-point

- Точность на forward pass: 8-бит после pruning

- Трансформер: 1 слой, 1 attention head

Задача простая, но не «тупая»: разворот 8 цифр

Задание для обучения выглядит детским: развернуть последовательность из восьми цифр в обратном порядке. Но фокус в том, что модели нужно выучить правило, которое сработает на любом входе, а не запомнить примеры. Пламмер прямо говорит, что это и есть «душа» того, как работают современные LLM: они ищут структуру в данных и закрепляют её через градиентные обновления.

Пламмер описывает процесс обучения образно, но по делу: сначала модель «тупит», loss высокий, точность хаотичная. Потом веса сходятся к устойчивому паттерну, attention находит карту разворота, и модель пересекает границу между угадыванием и знанием.

100% точности за 3,5 минуты на 47-летнем компьютере

В итоге эксперимент сошёлся в красивую цифру: 100% accuracy на задаче разворота после примерно 350 шагов обучения. На PDP-11/44 это заняло около 3,5 минуты. Пламмер уточняет, что системе помогла cache board.

Главная мысль Пламмера тут не про «смотрите, AI можно на калькуляторе». Он настаивает, что механика та же самая, что и у больших моделей. Разница — в масштабе вычислений и объёме параметров. «This old machine is not thinking in some mystical sense. It’s just grinding through arithmetic to update a few thousand carefully stored numbers. And that’s the whole game».

И ещё одна вещь, которую он проговаривает отдельно: «Constraints are not the enemy of engineering. Constraints are what force creative engineering to happen». По его версии, на фоне дефицита вычислительных ресурсов выиграют те, кто вернёт в AI старую школу эффективности и оптимизации.

Видео с демонстрацией Пламмер выложил публично: Dave Plummer.