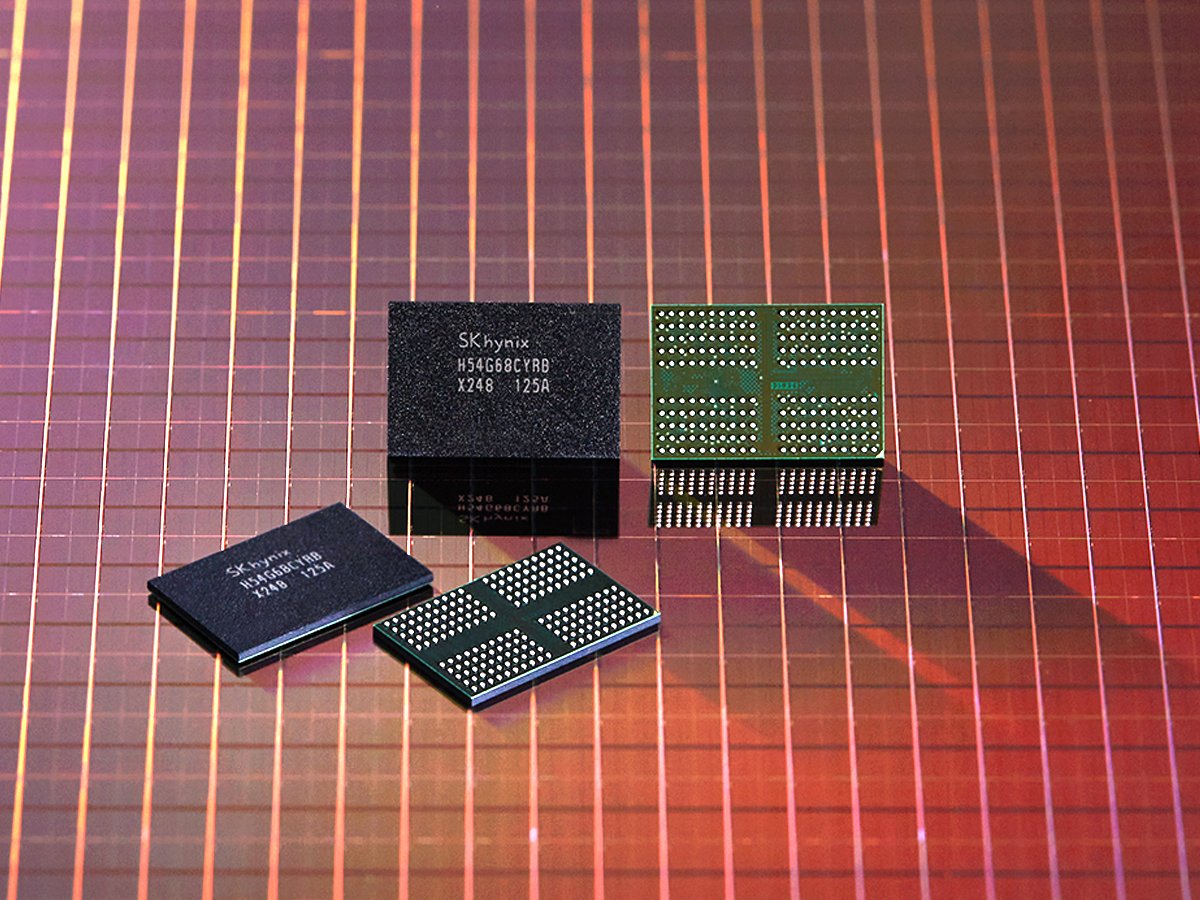

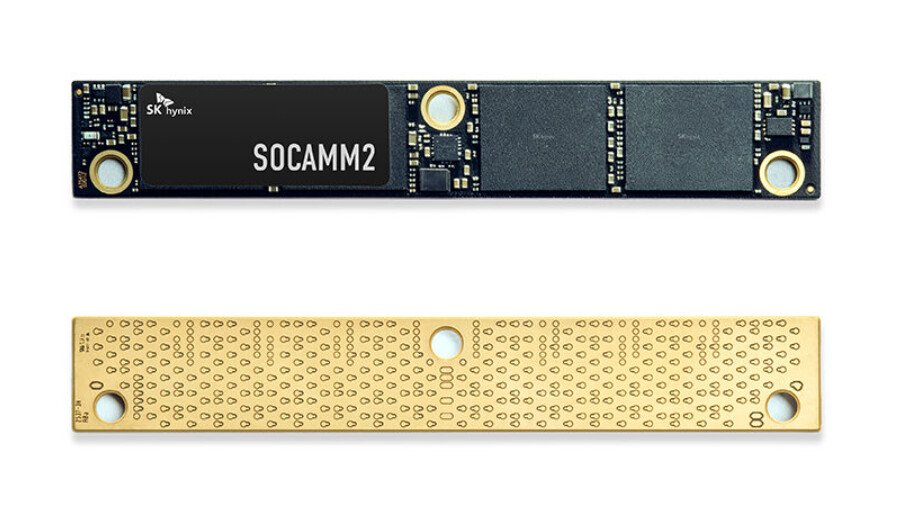

SK hynix 20 апреля 2026 года объявила о старте массового производства SOCAMM2 — модулей памяти объёмом 192 ГБ на базе LPDDR5X. Компания называет это стандартом следующего поколения для AI-серверов и делает акцент на снижении энергопотребления.

Ключевая идея SOCAMM2 простая: взять низковольтную память, которую мы привыкли видеть в смартфонах и ноутбуках, и адаптировать её под серверную стойку. SK hynix прямо говорит, что SOCAMM2 проектировали как основную оперативную память для следующего поколения AI-серверов.

SOCAMM2: LPDDR5X для серверов и ставка на эффективность

SOCAMM2 SK hynix делает на техпроцессе 1cnm (шестое поколение 10-нм класса). В качестве базовой DRAM компания использует LPDDR5X, то есть энергоэффективную память, которая исторически жила в мобильных устройствах.

По заявлению SK hynix, их SOCAMM2 на 1cnm даёт более чем двукратный прирост пропускной способности по сравнению с обычной RDIMM. Параллельно компания заявляет улучшение энергоэффективности более чем на 75% относительно RDIMM. В пресс-релизе это позиционируют как оптимизацию под высокопроизводительные AI-нагрузки, где теплопакет и питание давно стали узким местом.

Под какую платформу делают модули и зачем 192 ГБ на модуль

SK hynix отдельно уточняет, что её SOCAMM2 рассчитаны на платформу NVIDIA Vera Rubin. То есть это не абстрактная «память для серверов», а продукт, который сразу привязывают к конкретной будущей серверной экосистеме Nvidia.

Компания ожидает, что SOCAMM2 поможет снять «бутылочные горлышки» по памяти при обучении и инференсе больших языковых моделей. Речь про LLM с сотнями миллиардов параметров, где система упирается не только в ускорители, но и в то, как быстро и экономично можно кормить вычисления данными.

SK hynix также отмечает сдвиг фокуса AI-рынка от инференса к обучению. На этом фоне SOCAMM2 подают как следующий шаг: много памяти на модуль, при этом с низким энергопотреблением. Для облачных клиентов (CSP) компания заявляет, что не только сформировала линейку поставок, но и рано стабилизировала массовое производство.

Президент и руководитель направления AI Infra (CMO) SK hynix Джастин Ким сформулировал позицию компании так: «Поставляя 192 GB SOCAMM2, SK hynix установила новый стандарт производительности AI-памяти». Он добавил, что SK hynix намерена укреплять статус «самого доверенного» поставщика решений памяти для AI через тесную работу с глобальными клиентами.

Первоисточник: SK hynix.