Содержание

Гонка за ИИ-железом выходит на уровень, где на кону не только деньги, но и уголовные дела. Минюст США (DOJ) сообщил, что бывший инженер-программист Google Линьвэй Дин (Linwei Ding) был осуждён за экономический шпионаж и кражу конфиденциальных технологий, связанных с Google Tensor Processing Units (TPU).

По версии следствия, речь шла не о паре «интересных документов», а о системной попытке утащить знания о том, как устроены TPU и вся инфраструктура вокруг них — то есть то самое «секретное ДНК», которое позволяет Google строить свои ИИ-суперкомпьютеры и меньше зависеть от чужих GPU.

Что именно, по данным DOJ, было украдено

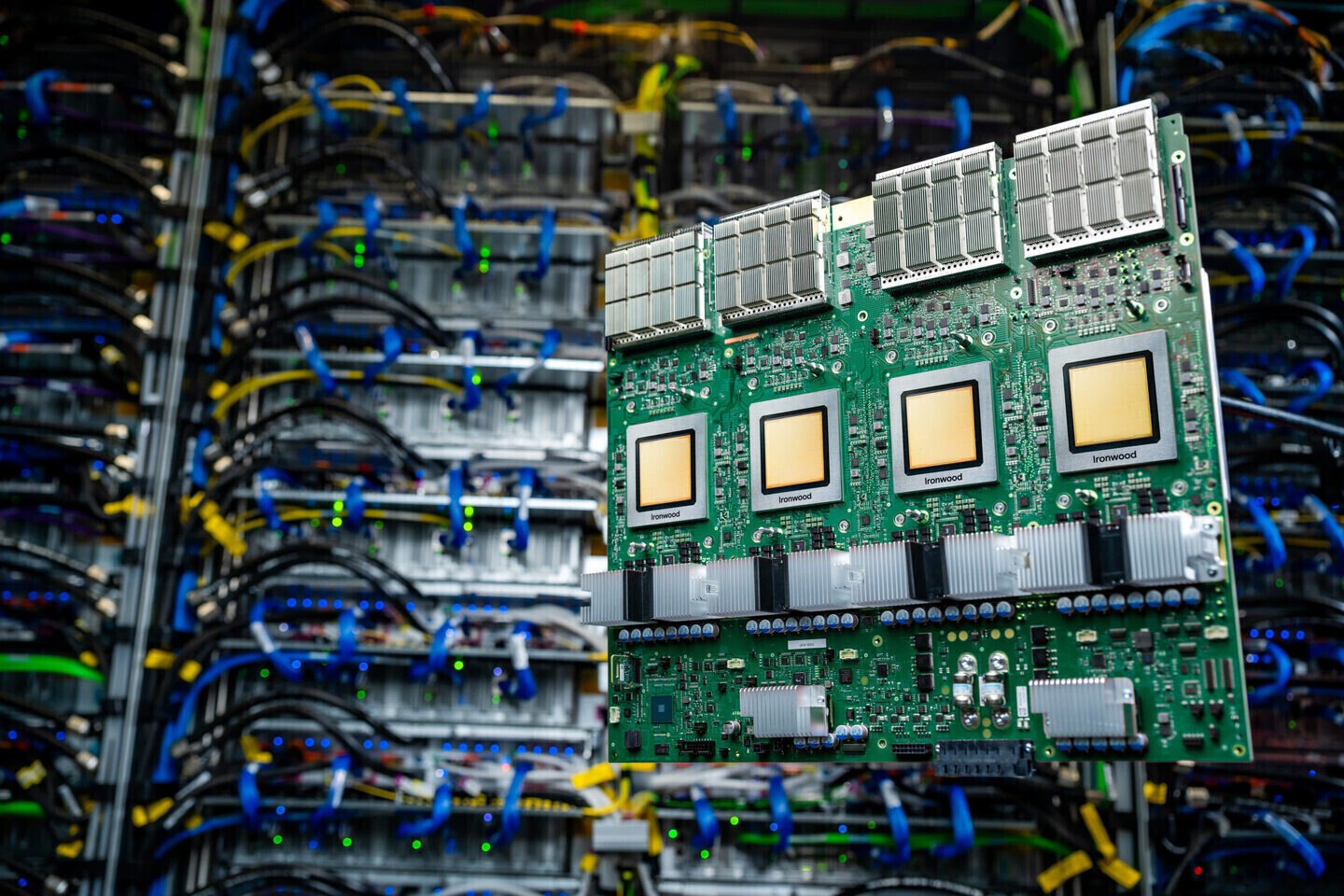

Расследование ФБР установило, что Дин подозревался в похищении информации о полном стеке TPU-инфраструктуры: от архитектуры чипов до внешней связности и компонентов, которые позволяют тысячам ускорителей работать как единое целое.

В заявлении DOJ подчёркивается: торговые секреты включали детальные сведения об архитектуре и функциональности кастомных TPU-чипов и систем, а также о GPU-системах Google. Отдельным блоком шли данные о программном обеспечении, которое обеспечивает коммуникацию между чипами и выполнение задач, и о софте, который «оркестрирует» тысячи чипов в суперкомпьютер для обучения и запуска передовых ИИ-нагрузок.

Также, по данным ведомства, в украденных материалах фигурировали сведения о SmartNIC — это специализированная сетевая карта (network interface card), которая нужна для высокоскоростного обмена данными внутри ИИ-суперкомпьютеров Google и в облачных сетевых продуктах компании.

-

- Чип-архитектура TPU

и устройство систем

- Связность и внешние интерфейсы

(как всё это соединяется)

- ПО для коммуникации и выполнения задач

на ускорителях

- ПО-оркестрация

тысяч чипов в кластере

- SmartNIC и сетевые компоненты для ИИ-суперкомпьютеров

DOJ утверждает, что Дин действовал в интересах КНР (People’s Republic of China), а целью было получение чувствительной интеллектуальной собственности, на которую Google потратила годы и миллиарды долларов. Google, со своей стороны, сотрудничала с ФБР и заявила, что бывший сотрудник вынес до двух тысяч страниц конфиденциальной информации.

Почему цель — именно TPU, а не «просто ещё один чип»

TPU — это не очередная «железка для нейросетей», а фундаментальная часть стратегии Google: держать ключевую ИИ-инфраструктуру у себя и снижать зависимость от внешних поставщиков GPU вроде AMD и NVIDIA. В материале подчёркивается, что уникальная архитектура и инфраструктура Google как раз и позволяет компании меньше опираться на внешний рынок ускорителей.

Отдельно упоминается, что Gemini 3, по данным источника, был обучен и сейчас эксплуатируется исключительно на TPU, без участия GPU от NVIDIA или AMD. Это важный маркер: если модель такого масштаба действительно живёт на собственных ускорителях, то ценность внутренних разработок Google возрастает кратно — и для бизнеса, и для конкурентов.

Google, как сообщается, вывела на арену две вариации TPU поколения v8: TPUv8ax с кодовым именем Sunfish для обучения моделей уровня Gemini и TPUv8x (Zebrafish) для масштабного инференса — то есть для «прогона» модели в продакшене, когда она отвечает пользователям.

Железо плюс сеть: где на самом деле спрятана «магия»

В этой истории важно понимать: в ИИ-суперкомпьютерах решает не только мощность одного ускорителя. Ключ — в том, как соединить десятки тысяч таких чипов так, чтобы они не простаивали, не упирались в сеть и эффективно делили между собой данные и вычисления.

Именно поэтому в материалах DOJ отдельно всплывает SmartNIC и «всё вокруг TPU». Если у тебя есть схема чипа, но нет понимания, как устроены коммуникации, оркестрация и сетевой слой, ты всё равно не сможешь быстро повторить систему уровня гиперскейлера. А если есть — ты резко сокращаешь годы исследований и огромные бюджеты.

Также в исходнике отмечается, что для Sunfish Google сотрудничала с Broadcom и собственной командой кастомного дизайна, которая отвечает за проектирование «под ключ»: дизайн, память, вспомогательное железо и упаковку. Иными словами, это не «купили чипы и воткнули в сервер» — это вертикально интегрированный продукт, оптимизированный под конкретные задачи.

Что это значит для рынка и для обычных пользователей

С точки зрения индустрии это ещё одно подтверждение: «AI arms race» — не метафора, а реальность, где интеллектуальная собственность становится стратегическим активом. Чем сильнее компании замыкают на себе вычислительную базу (TPU у Google, собственные ускорители и платформы у других игроков), тем выше ставки и тем жёстче будет защита — юридическая, техническая и организационная.

Для пользователей это обычно проявляется не в заголовках DOJ, а в том, насколько быстро и стабильно развиваются сервисы: облачные ИИ-инструменты, поиск, ассистенты, генерация текста/кода/картинок. Если Google действительно может обучать и обслуживать большие модели на своих TPU, это потенциально означает более предсказуемую себестоимость и меньше зависимость от дефицитов на рынке GPU — а значит, больше шансов, что новые функции будут выкатываться быстрее и дешевле в эксплуатации.

Но есть и обратная сторона: чем больше инфраструктура завязана на закрытые решения, тем сильнее «стены» между экосистемами. Для рынка это может означать усиление конкуренции не только «модель против модели», но и «платформа против платформы», где железо, сеть и софт — единый пакет.

История с Линьвэем Дином показывает, что охота идёт уже не за отдельными алгоритмами, а за целыми архитектурами ИИ-суперкомпьютеров — от чипа до сетевой карты и оркестрации кластера. Дальше логично ждать усиления внутренней безопасности у крупных техкомпаний и ещё большего внимания к тому, кто и как получает доступ к критичным данным вокруг TPU и других ускорителей.