Содержание

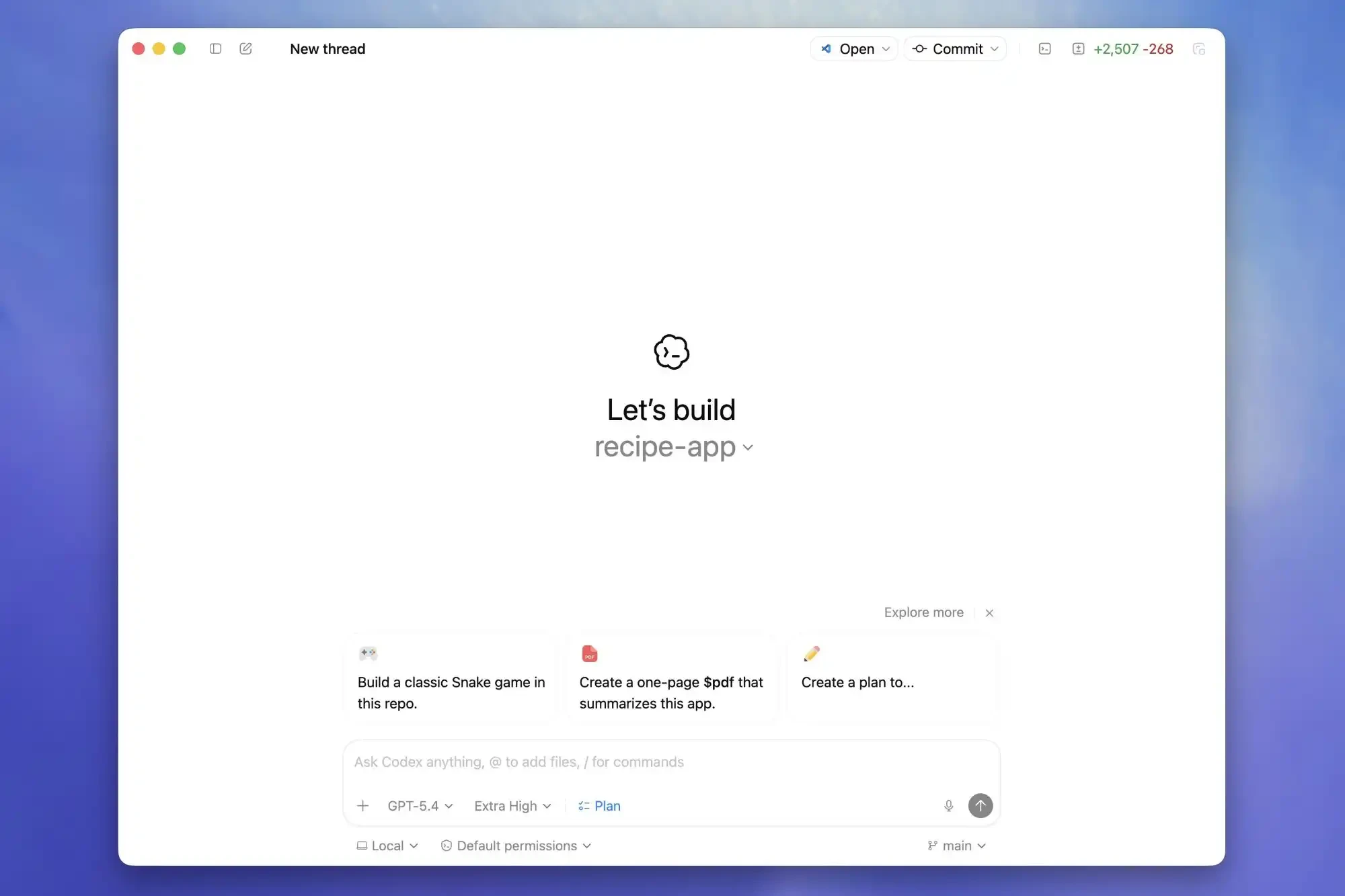

OpenAI выпустила флагманскую модель GPT-5.4, заточенную под «агентный» сценарий. Теперь LLM не только отвечает в чате, но и может выполнять действия на компьютере — кликать мышью, вводить команды с клавиатуры и редактировать файлы, если вы подключаете её через API или Codex.

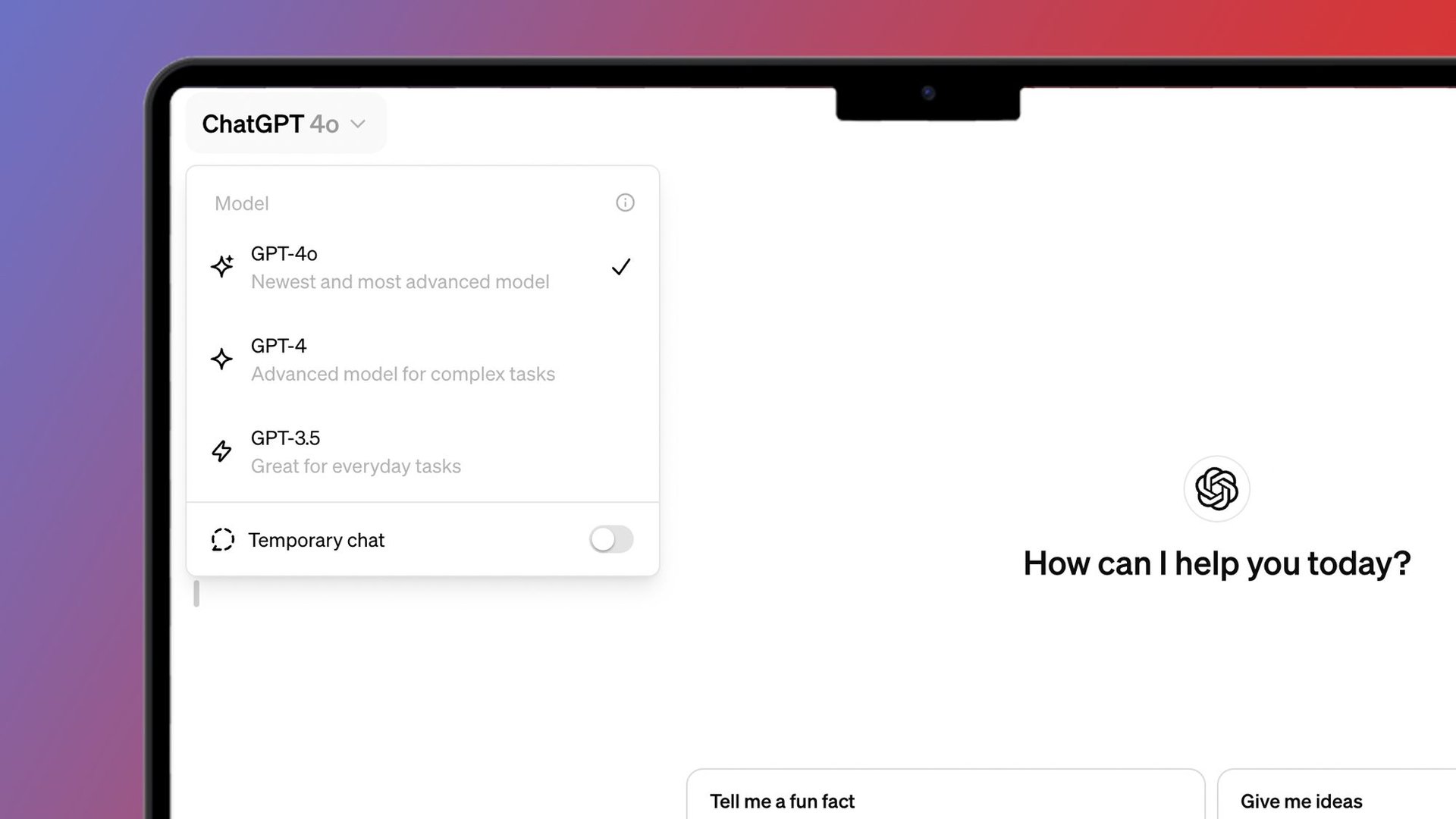

В ChatGPT модель доступна под названием GPT-5.4 Thinking. Параллельно её добавили в OpenAI API и в Codex, включая версию Codex для Windows.

Чем GPT-5.4 отличается от прошлых «просто чат-ботов»

GPT-5.4 — это первый «общего назначения» GPT от OpenAI, который в связке с агентной системой может реально управлять вашим ПК. Речь не про магию внутри модели: она выдаёт команды вроде «кликни сюда», а агентный слой на компьютере выполняет клик и возвращает результат.

На практике это сводится к трём ключевым возможностям:

- Компьютерные действия: клики мышью, ввод с клавиатуры, работа с окнами.

- Работа с файлами: модель может инициировать правки и операции с файлами на системе через агент.

- Зрение через скриншоты: модель «видит» снимки экрана, поэтому может ориентироваться в браузере и интерфейсах программ.

Если вы помните эпоху «AI подсказывает, куда нажать», то тут концепция меняется. Вы формулируете задачу, а дальше агент делает клики сам.

Где GPT-5.4 реально получает доступ к компьютеру, а где нет

Ограничение жёсткое: управление ПК работает, когда вы используете GPT-5.4 через OpenAI API или через Codex. В режиме GPT-5.4 Thinking внутри ChatGPT (в десктопном приложении или веб-интерфейсе) модель остаётся «запертой» в чатбоксе.

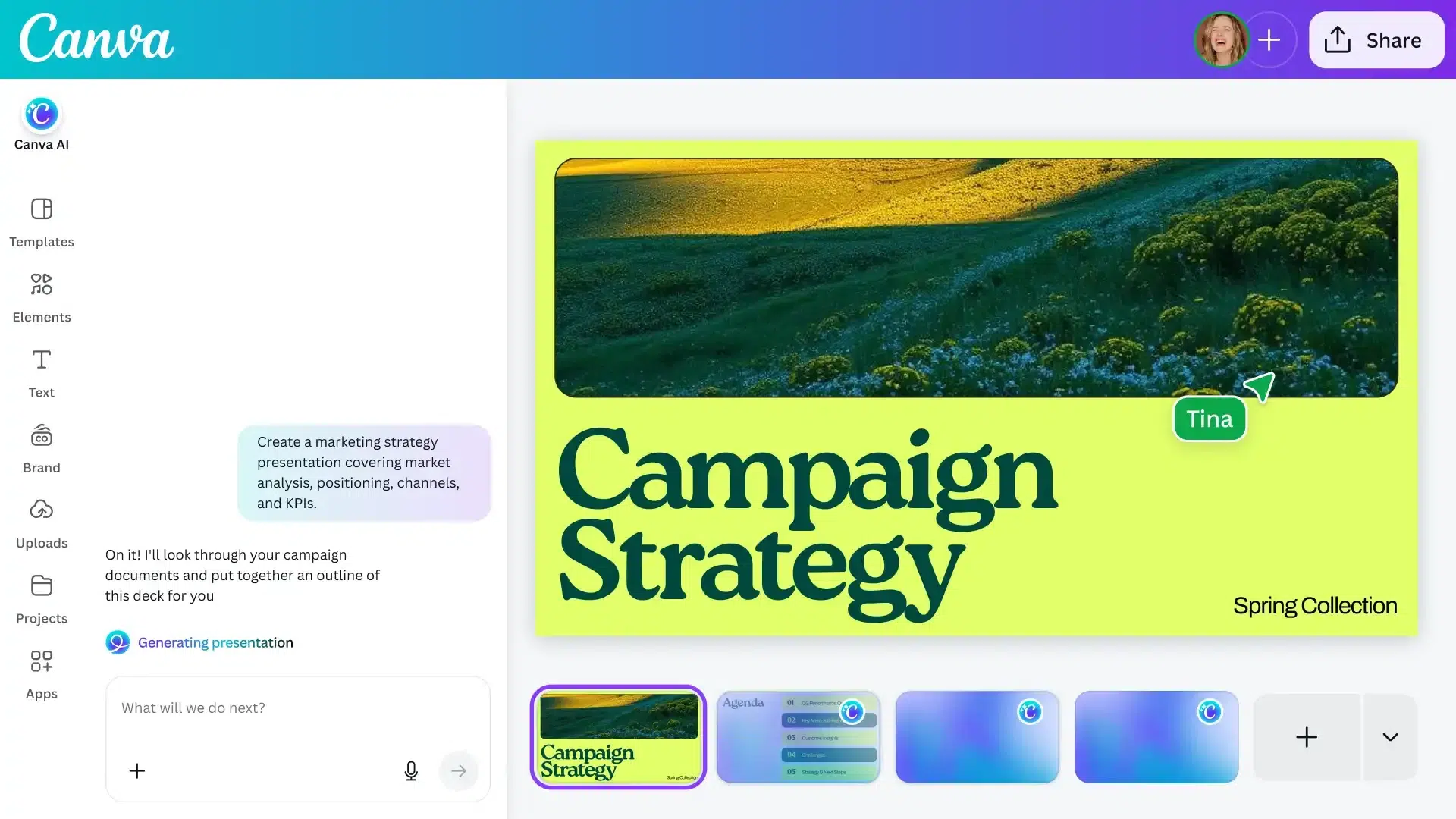

При этом в ChatGPT остаются интеграции с внешними сервисами и приложениями. В списке упоминаются Google Drive, Spotify, Adobe Photoshop и другие. Но это не то же самое, что полный контроль над вашим рабочим столом.

Что улучшили внутри: таблицы, рассуждения и план перед запуском задачи

OpenAI добавила в GPT-5.4 несколько практичных улучшений, которые важны именно для «агентных» задач. Модель прокачали в работе с таблицами, а ещё она стала эффективнее рассуждать и решать задачи с меньшим числом токенов. Это напрямую влияет на стоимость запросов, если вы гоняете модель через API.

Ещё одна важная деталь — модель умеет показывать «upfront»-план перед выполнением сложной задачи. То есть сначала она описывает шаги, а уже потом начинает действовать. Это даёт шанс вовремя поправить курс, пока агент не полез менять файлы или кликать в бухгалтерии.

Официальное описание нововведений OpenAI собрано на странице: Introducing GPT-5.4.

Почему это не «первый GPT, который умеет команды», но шаг шире

OpenAI уже делала модели и конфигурации, заточенные под выполнение команд, правку файлов и частичную навигацию по интерфейсам — прежде всего в линейке Codex. Разница GPT-5.4 в том, что это первый «general-purpose» GPT, который разворачивает computer-use сценарий на уровень выше: с просмотром веба, работой со скриншотами и взаимодействием с обычными программами на ПК.

В качестве примера приводят сценарий уровня «сделай сверку в Quicken». Теоретически агент с GPT-5.4 может сам запустить приложение, пройти по меню и выполнить задачу. Но для таких чувствительных вещей логичнее держать человека рядом и смотреть, что именно агент делает в окнах и какие файлы трогает.

GPT-5.4 уже доступна в ChatGPT как GPT-5.4 Thinking, а также через OpenAI API и Codex, причём контроль ПК заявлен именно для API и Codex.