Содержание

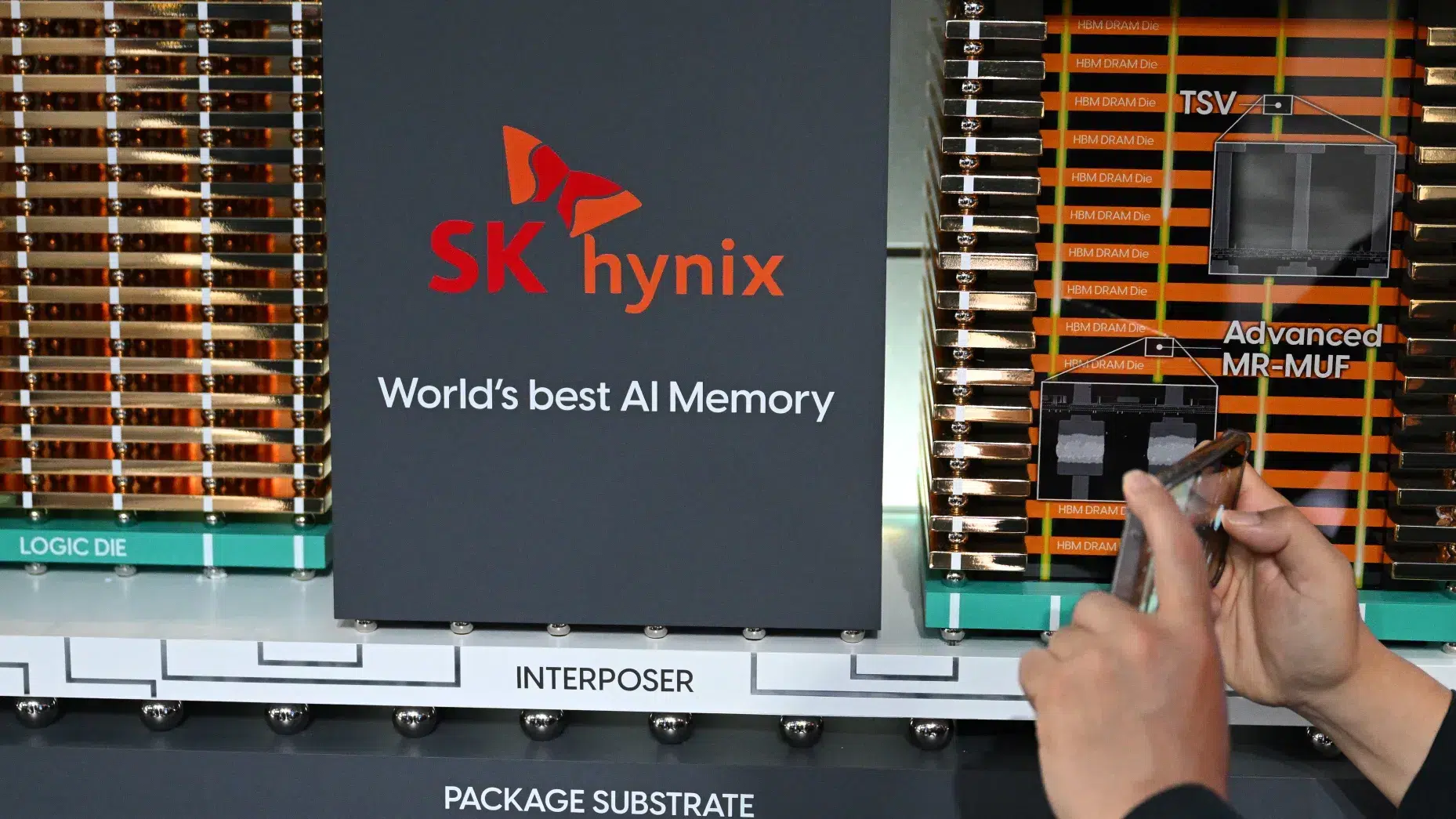

SK Hynix объявила, что вложит 19 трлн корейских вон (около $12,9 млрд) в новый завод — на фоне продолжающегося дефицита и роста цен на память. Речь не про очередную «фабрику чипов вообще», а про производство, завязанное на бум искусственного интеллекта: компания строит предприятие по advanced packaging, то есть продвинутой упаковке памяти.

Если коротко: когда Nvidia и другие игроки гонят рынок ИИ вперёд, им нужна не просто «ещё DRAM», а HBM-память (high-bandwidth memory) и умение собирать её в максимально плотные и эффективные модули. SK Hynix сейчас — один из ключевых поставщиков такой памяти, и компания явно не хочет упустить момент.

Что именно строит SK Hynix и где

Новый завод появится в городе Чхонджу (Cheongju) в Южной Корее — там у SK Hynix уже есть производственная база, и компания расширяет существующий кластер. Строительство стартует в апреле, а завершение намечено на конец 2027 года, говорится в заявлении компании.

Фокус предприятия — advanced packaging. Это важная деталь: в мире ИИ решает не только то, сколько кристаллов памяти ты произвёл, но и как ты их собрал в единый модуль. Современная упаковка позволяет объединять несколько чипов в один высокоплотный «бутерброд», повышая производительность и энергоэффективность и одновременно уменьшая габариты.

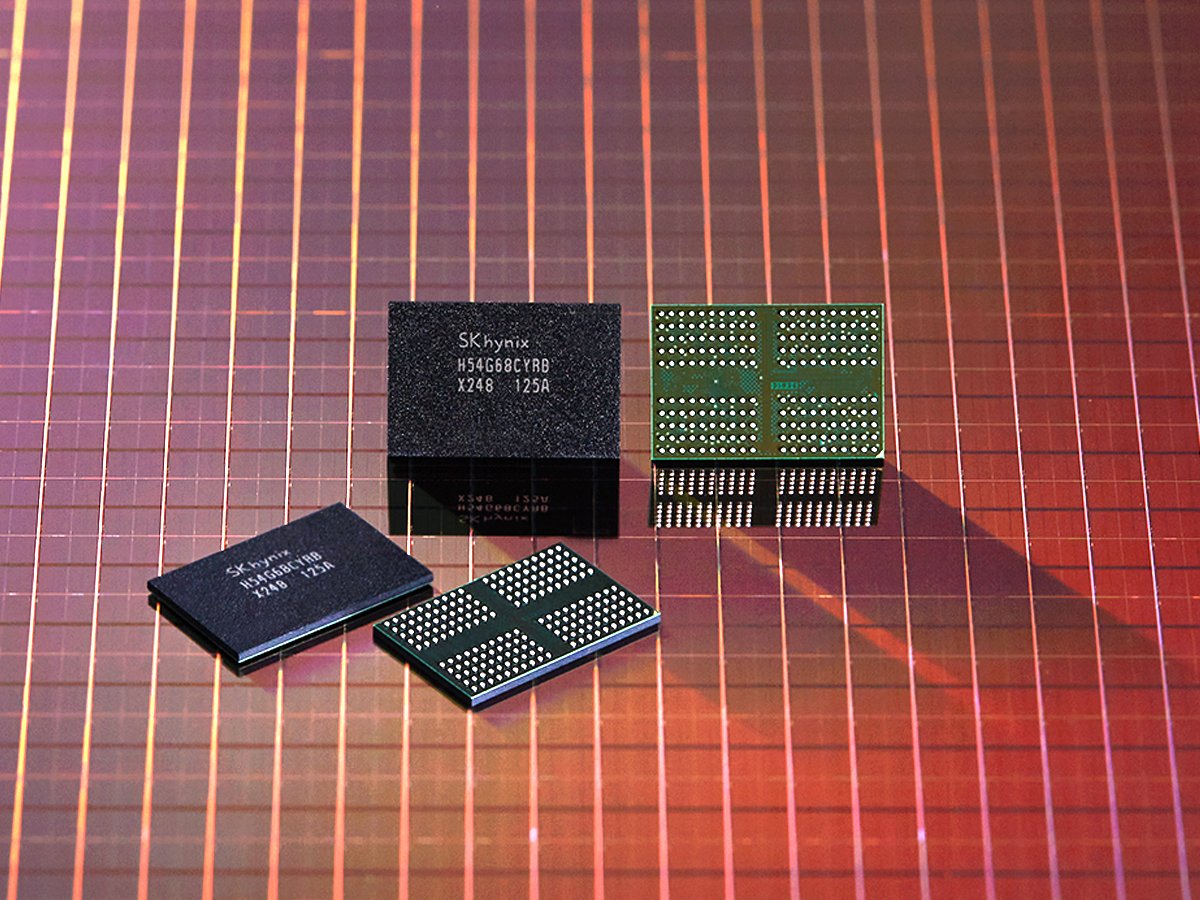

SK Hynix — один из крупнейших производителей памяти в мире и лидер в сегменте HBM, который используется в ИИ-процессорах, включая решения, которые проектирует Nvidia. Именно HBM стала одной из самых горячих точек всей цепочки поставок для AI-инфраструктуры.

Почему все упёрлись в HBM и «упаковку»

HBM — это память с очень высокой пропускной способностью, которая критична для обучения и работы больших моделей. В отличие от «обычной» памяти, здесь важны не только объёмы, но и то, насколько быстро данные «крутятся» между ускорителем и памятью. Поэтому спрос на HBM растёт вместе с гонкой ИИ — и это уже заметно по рынку.

По оценкам отрасли, которые цитирует сама SK Hynix, рынок HBM может расти со среднегодовым темпом 33% в 2025-2030 годах. На этом фоне конкуренты тоже ускоряются: Samsung Electronics в последние месяцы также заявляла о планах наращивать выпуск HBM.

Но есть нюанс: HBM — штука заметно более сложная в производстве, чем память, которая идёт в массовую потребительскую электронику. То есть «переключить мощности» в сторону ИИ — не так просто, и рынок ощущает последствия. Когда производители памяти тянут ресурсы туда, где маржа выше (ИИ), предложение «обычной» памяти сжимается — и цены начинают ползти вверх.

Цены на память растут — и это касается не только дата-центров

Исследовательская компания TrendForce на прошлой неделе сообщила, что ожидает роста средних цен на DRAM (включая HBM) на 50-55% в этом квартале по сравнению с четвёртым кварталом 2025 года. DRAM — это та самая оперативная память, которая стоит в большинстве компьютеров и отвечает за временное хранение данных.

Для производителей электроники рост цен на память — головная боль: дорожают компоненты, сложнее удерживать цены на готовые устройства, а маржа может проседать. Зато для самих «памятных гигантов» это, наоборот, сильный попутный ветер. Например, Samsung на прошлой неделе заявила, что ожидает, что операционная прибыль за декабрьский квартал почти утроится год к году.

На этом фоне инвестиции SK Hynix выглядят как ставка на то, что дефицит и высокий спрос — история не на пару месяцев. Компания расширяет именно ту часть цепочки, которая становится узким горлышком для HBM: продвинутую упаковку и сборку высокоплотных решений.

- Кому это выгодно: производителям памяти и поставщикам AI-инфраструктуры.

- Кому сложнее: брендам ПК/серверов и производителям электроники, которые закупают DRAM.

- Что в центре: HBM и мощности по advanced packaging.

Что это значит для пользователей и рынка ПК

Если вы не строите дата-центр для обучения моделей, вопрос «почему SK Hynix строит завод упаковки HBM» всё равно вас касается — просто через цены и доступность комплектующих. Когда отрасль массово переориентируется на ИИ-заказы, предложение по традиционной памяти может становиться более жёстким, а это отражается на стоимости оперативки в ПК и серверных конфигурациях.

Вторая сторона — технологическая. Чем лучше производители научатся делать HBM и собирать её в плотные модули, тем быстрее будет развиваться вся экосистема ускорителей: от GPU для облаков до специализированных ИИ-процессоров. Это влияет на темпы внедрения ИИ-сервисов, которые мы видим каждый день — от генеративных помощников до поиска и обработки видео.

Есть и финансовый штрих: SK Hynix, по данным CNBC, рассматривает потенциальный листинг в США после сильного 2025 года для акций в Южной Корее. С начала этого года бумаги выросли примерно на 12%, хотя во вторник на торгах просели примерно на 2,5%.

Итог простой: SK Hynix делает крупную и довольно точечную ставку на HBM и advanced packaging, потому что именно там сейчас узкое место для ИИ-рынка и источник высокой маржи. До конца 2027 года завод ещё нужно построить, но сам сигнал рынку понятен: дефицит памяти и рост цен — это не случайная вспышка, а следствие долгого AI-цикла, который только набирает обороты.