Содержание

NVIDIA пока не планирует переходить на HBF (High-Bandwidth Flash) — память со стеком до 4 ТБ, которую разрабатывают SanDisk и SK hynix. Компания собирается дальше опираться на HBM, а проблему ёмкости закрывать быстрыми eSSD.

HBF: до 4 ТБ в одном стеке, но HBM всё равно быстрее

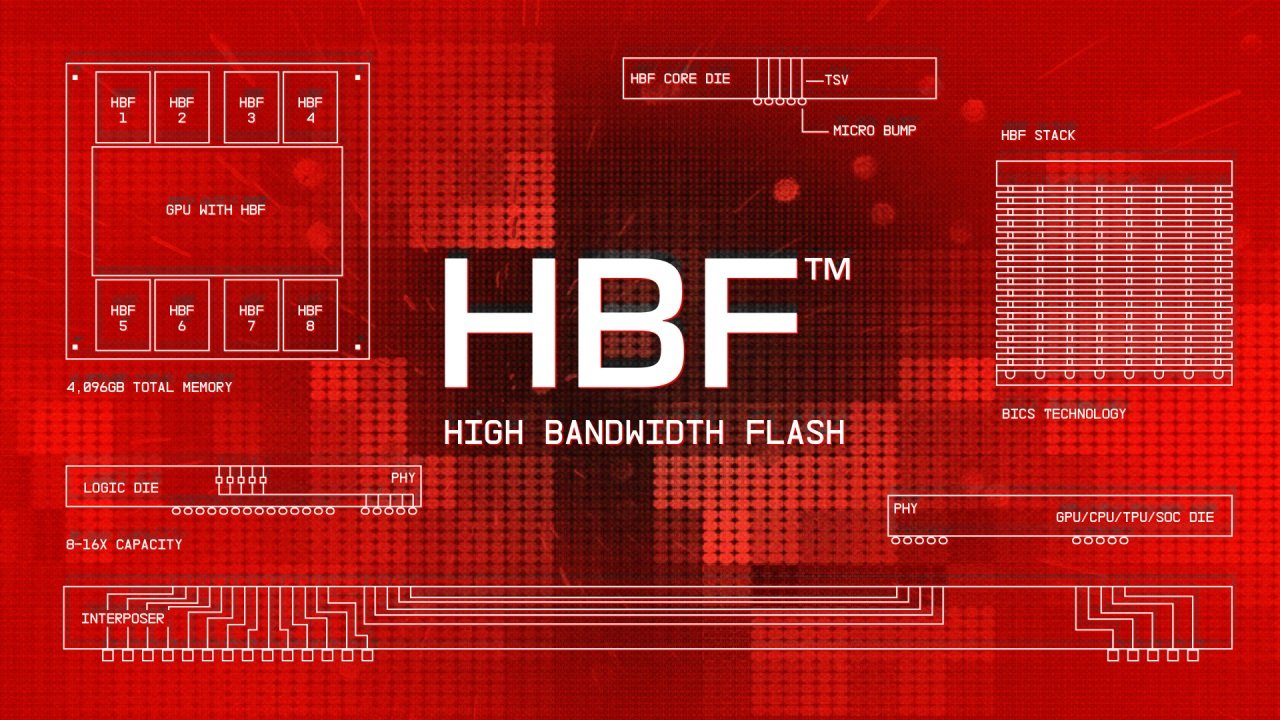

HBF — это следующая ступень идеи «память в стеках», но вместо DRAM там используют многослойную NAND Flash. Технологию совместно развивают SanDisk и SK hynix.

По архитектуре подход близок к HBM: несколько слоёв складывают в один стек и соединяют через TSV (Through Silicon Vias), чтобы получить единый модуль. Ключевое отличие в ёмкости. Сейчас HBM даёт примерно 32-64 ГБ на стек, а HBF, по планам разработчиков, масштабируется до 4 ТБ на стек.

По скорости HBM остаётся впереди. Но разработчики HBF рассчитывают, что оптимизации дадут пропускную способность, достаточную для части AI-задач.

Почему HBF продвигают под инференс и «агентные» модели

HBF целят в сценарии, где критичны объём и «достаточная» полоса, а не абсолютный максимум скорости. В первую очередь это инференс, который сейчас растёт на фоне интереса к agentic AI.

Большая ёмкость помогает и с типичной болью современных LLM — хранением KV cache ближе к вычислителю. Чем больше памяти рядом с чипом, тем меньше приходится упираться в обмен с более медленными уровнями иерархии.

Параллельно индустрия вообще активнее смешивает миры NAND и DRAM. На фоне AI-бума «NAND DRAM» (как формулируют это в отраслевых обсуждениях) получает всё больше внимания: флеш давно живёт в SSD, но теперь её пытаются подтянуть ближе к вычислениям.

Позиция NVIDIA: HBM остаётся, а ёмкость закроют eSSD и PCIe Gen7

По данным отраслевых источников, NVIDIA не рассматривает HBF как ближайшую замену HBM. Логика простая: компания считает, что ограничения по ёмкости и скоростям можно закрывать через eSSD.

Отдельно упоминают работу NVIDIA с Kioxia над SSD на PCIe Gen7. В обсуждениях фигурирует оценка: такие решения могут быть «до 100 раз быстрее стандартных дизайнов».

Это хорошо ложится в стратегию NVIDIA последних лет: держать максимально быстрый уровень памяти на HBM, а дальше наращивать объём через более дешёвые и ёмкие уровни, не переплачивая за «терабайты HBM».

Кто может стать первым большим клиентом: Google и TPU

Если NVIDIA пока держится за HBM, то Google, по данным тех же отраслевых источников, рассматривают как одного из ключевых будущих клиентов HBF. Компания расширяет свою TPU-экосистему и готовит несколько решений следующего поколения.

У HBF тут есть ещё один потенциальный сценарий, кроме «замены HBM». В обсуждениях звучит идея, что технология может претендовать и на роль альтернативы DDR в серверах, где важны плотность, энергопотребление и место на плате.

Серверный рынок уже двигается в сторону LPDDR, потому что в AI всё чаще упираются в CPU и память. Отсюда растущий спрос на LPDDR5 и LPDDR5X, включая форм-фактор SOCAMM2. Многослойная компоновка HBF теоретически даёт способ уменьшить площадь PCB и поднять ёмкость при низком энергопотреблении, сохраняя высокую пропускную способность.

SK hynix сейчас лидирует в разработке HBF, а первые образцы памяти компания планирует начать поставлять во второй половине 2026 года.