Содержание

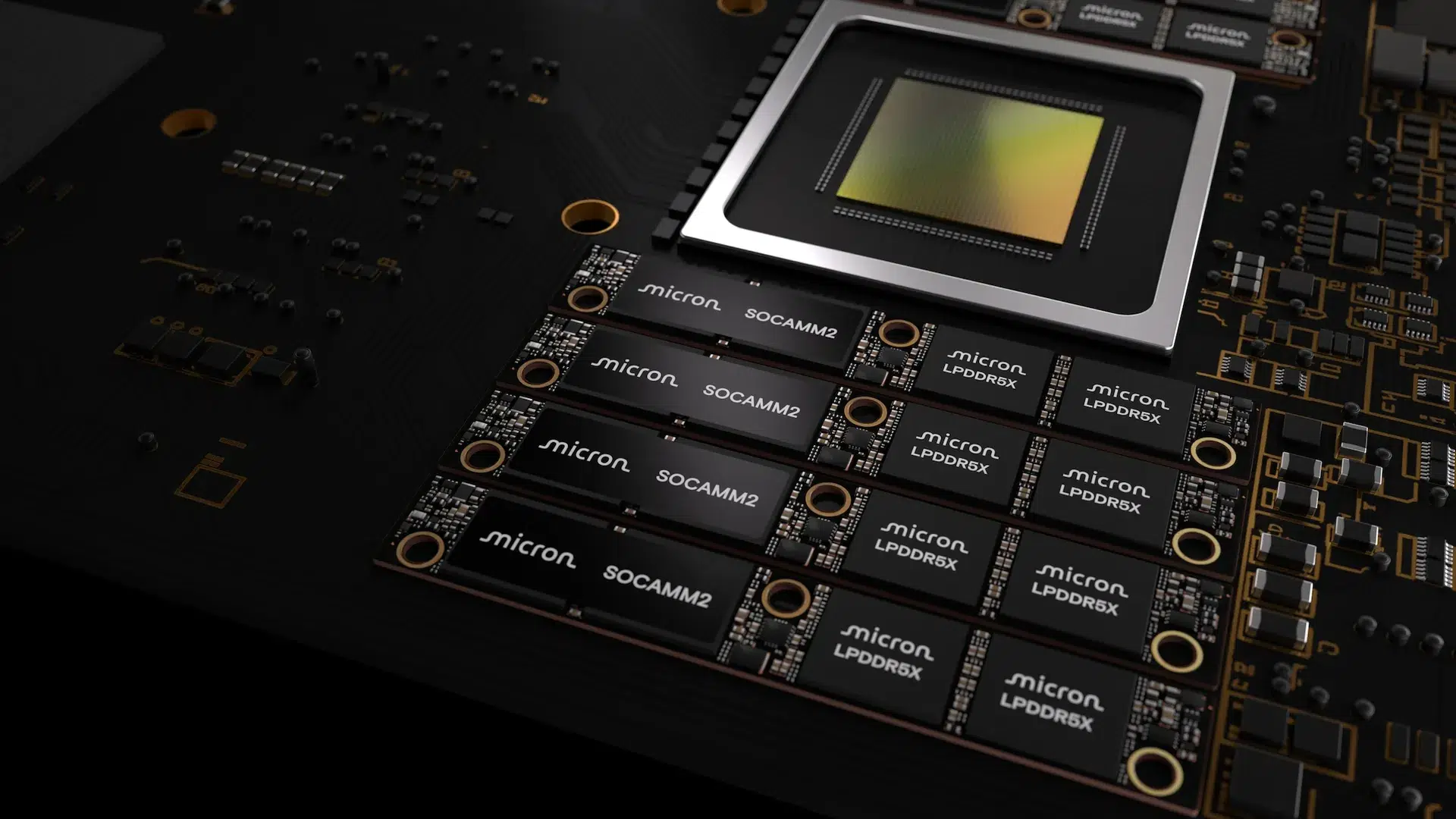

Micron начала отгружать клиентам первые образцы модулей SOCAMM2 объёмом 256 ГБ. Для ИИ-серверов это прямой путь к конфигурациям, где к одному процессору подключают до 2 ТБ оперативной памяти.

Речь про память в форм-факторе SOCAMM2, который нацелен на плотные и энергоэффективные узлы в дата-центрах. Micron говорит, что это первые в индустрии 256-гигабайтные SOCAMM2. И это заметный скачок за короткий срок: предыдущее «лучшее» значение в этом же семействе — 192 ГБ — компания показывала всего шесть месяцев назад.

Что дают 256 ГБ SOCAMM2 в стойке с ИИ-ускорителями

Главный практический эффект — больше ОЗУ ближе к CPU в системах, где каждый гигабайт памяти под нагрузкой превращается в деньги. Micron приводит понятный ориентир: типовая стойка Nvidia NVL72 при такой памяти может нести до 72 ТБ ОЗУ на 36 CPU.

Такая ёмкость важна не только для «влезло/не влезло». Micron связывает рост доступной памяти с реальной работой LLM: больше ОЗУ на процессоре позволяет держать более крупные контекстные окна. А это помогает снижать TTFT (Time To First Token) — время до появления первого токена в ответе. Проще говоря, бот начинает отвечать быстрее.

Плотность выше, а потребление ниже

Рост ёмкости — не единственный аргумент SOCAMM2. Micron заявляет, что новые модули должны дать до 66% лучшую энергоэффективность по сравнению с обычными RDIMM. Для ИИ-серверов это критично: теплопакет и лимиты по питанию давно стали таким же узким местом, как вычисления.

Ещё один момент — охлаждение. Micron подчёркивает совместимость SOCAMM2 с всё более популярным жидкостным охлаждением в ИИ-стойках. В плотных конфигурациях это уже не экзотика, а часто вынужденная мера.

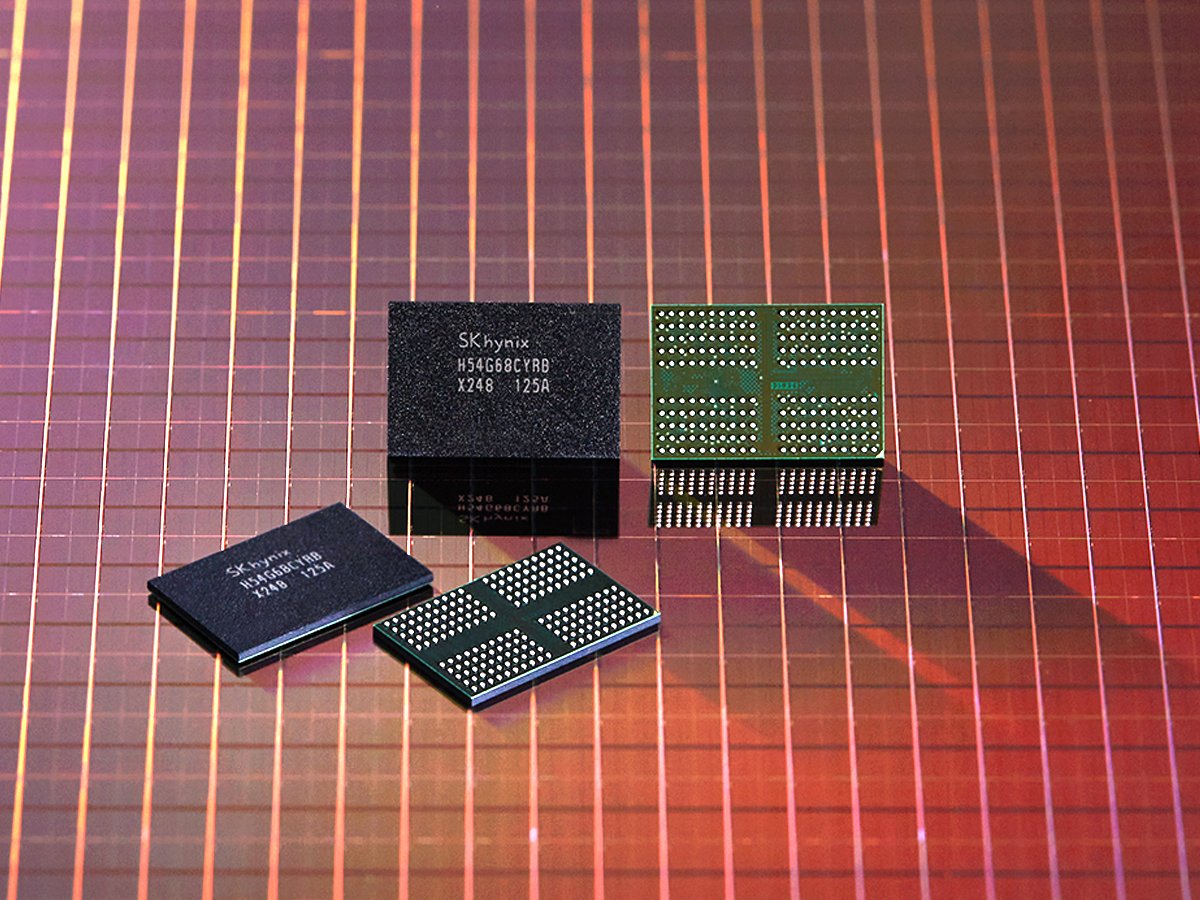

На каких чипах собраны новые SOCAMM2

Micron уточняет, что модули первыми используют её 32 Gb (то есть 4 ГБ) LPDDR5X чипы в «монолитном» исполнении. Под «monolithic» компания понимает один кристалл, где память и связанная логика находятся на одном die.

Чем 256 ГБ отличаются от 192 ГБ SOCAMM2

Если сравнивать с предыдущим поколением SOCAMM2 на 192 ГБ, Micron говорит о приросте плотности на 33% всего за шесть месяцев. Для рынка серверной памяти это быстрый темп, особенно когда речь про форм-фактор под ИИ и ограничения по теплу.

Откуда взялся SOCAMM2 и почему его продвигают

SOCAMM2 — это результат партнёрства Nvidia с производителями памяти, включая Micron, Samsung и SK hynix. SOCAMM изначально спроектировала Nvidia, но при попытке использовать такие модули в высокоплотных серверах компания столкнулась с перегревом. В итоге Nvidia подключила профильных производителей памяти, и так появились SOCAMM2 с ростом ёмкости и снижением энергопотребления.

Статус: это образцы для клиентов, не розница

На момент публикации Micron говорит именно о поставках семплов клиентам. Это дата-центровый продукт, поэтому в рознице, включая российские магазины, такие модули ждать не стоит. Цены компания не называла.

Подробнее про прошлый анонс SOCAMM2 на 192 ГБ можно посмотреть в архиве пресс-релизов Micron: страница на investors.micron.com.

Источники: Micron