Содержание

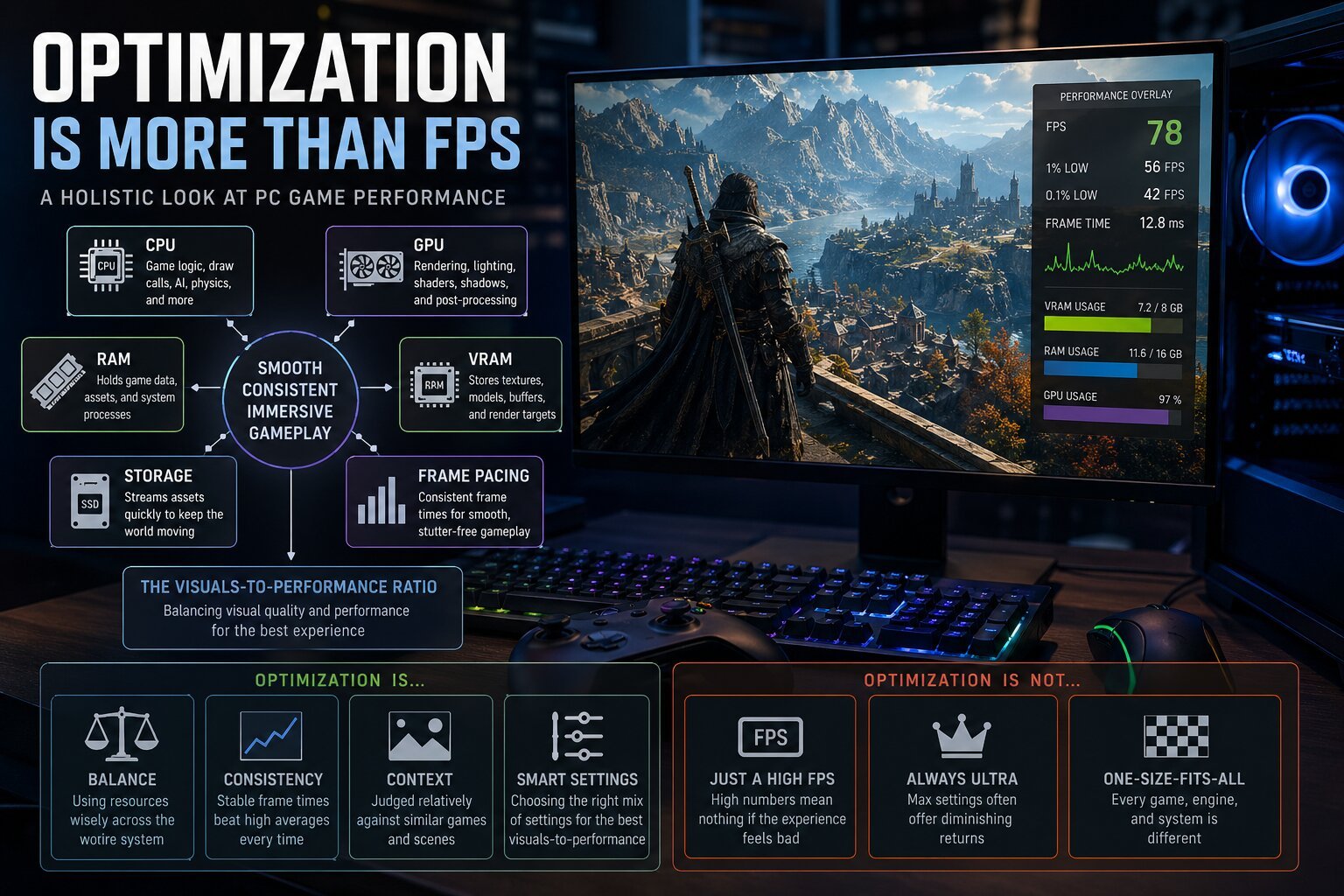

Споры про «плохую оптимизацию» в ПК-играх снова упёрлись в одну цифру — FPS. Но средний фреймрейт часто врёт: игра может держать 90 кадров, и при этом дёргаться так, что играть неприятно.

Технический разбор проблемы сводится к простой мысли: оптимизация — это не «сколько нагрузили видеокарту», а баланс всей системы. И оценивать его по одному счётчику кадров — как мерить машину только максималкой.

Оптимизация — это задача для всего ПК, а не только для видеокарты

Производительность в современных играх складывается из нескольких узких мест. GPU рендерит геометрию и свет, CPU ведёт симуляцию, готовит команды рендера и обслуживает кучу игровых систем. Параллельно игра постоянно таскает данные через память и накопитель.

Если упёрлись в процессор, снижение графики почти не помогает. Видеокарта просто ждёт, пока CPU «докинет» работу. Типичный сценарий — сцены с большим числом NPC, физикой и сложной логикой, где CPU забивается раньше GPU.

Отдельная боль — память. Когда игра вылезает за лимит VRAM, ОС начинает тасовать данные между видеопамятью и системной RAM. Итог знакомый: подёргивания, подгрузки текстур, резкие провалы кадров после входа в новый район.

Средний FPS не показывает, почему игра «дергается»

Ключевой показатель плавности — не средний FPS, а frametime, то есть время отрисовки каждого кадра. Для ориентира: при 120 FPS кадр должен укладываться примерно в 8,3 мс. Чем ровнее этот ритм, тем «маслянистее» картинка.

Проблема в том, что средняя цифра сглаживает пики. Игра может показывать 90 FPS «в среднем», но с регулярными скачками времени кадра. Поэтому в бенчмарках смотрят 1% и 0,1% lows — они лучше ловят статтеры и хичи.

И да, генерация кадров не лечит первопричину. DLSS/FSR Frame Generation может визуально сгладить поток, но если базовая частота кадров нестабильна или есть задержки и микрофризы, технология скорее маскирует симптомы.

«Ultra» — плохая точка отсчёта для разговоров про оптимизацию

Максимальные пресеты часто делают «на вырост». Это не баг и не заговор, а практика: разработчики закладывают режимы, которые раскроются на будущих видеокартах. Поэтому честнее оценивать оптимизацию по тому, насколько хорошо игра масштабируется настройками и насколько разумный «визуал за потраченные ресурсы» она даёт.

Показательный пример — Red Dead Redemption 2 на старте ПК-версии. Многие выкручивали всё в Ultra и получали резкое падение производительности. При этом точечная настройка нескольких тяжёлых параметров (вроде воды и освещения) давала кратный рост FPS с минимальными потерями в картинке.

Компиляция шейдеров и PSO — «злодей» эпохи DirectX 12 и Vulkan

Отдельный класс проблем — статтеры из-за компиляции шейдеров. Шейдеры и PSO (pipeline state object) часто компилируются под конкретную связку GPU и драйвера. Если это происходит во время геймплея, вы ловите заметный «тычок» ровно в момент появления нового эффекта.

Экран «Compiling shaders» перед первым запуском раздражает, но обычно лучше, чем микрофризы в бою. Хорошая реализация старается максимально подготовить шейдеры заранее.

Как честнее говорить об оптимизации

Техническая рамка здесь понятная: оптимизация — это бюджет ресурсов на кадр. И вопрос не в том, «сколько FPS», а в том, насколько умно игра тратит CPU, GPU и память, и насколько визуальная отдача соответствует цене в железе.

- Сравнивайте масштаб: коридорный шутер и огромный опенворлд нельзя мерить одной линейкой.

- Тестируйте одинаковые сцены: шумные локации и повторяемые участки важнее «тихих коридоров».

- Смотрите не только среднее: 1% и 0,1% lows лучше показывают статтеры.

- Оценивайте «оптимизированные» настройки: важен sweet spot, а не ультра-пресет.

- Учитывайте память и накопитель: VRAM/RAM и стриминг ассетов часто ломают плавность.

Если нужен быстрый ориентир по терминам, вот базовые справки: frames per second (FPS), graphics processing unit (GPU), video random-access memory (VRAM).

Цифра, вокруг которой крутится половина споров, остаётся прежней: при цели 120 FPS игра должна держать около 8,3 мс на кадр — и именно стабильность этого времени чаще всего «ломает» ощущение плавности.