Содержание

На конференции RSAC 2026 Microsoft рассказала о характерном признаке «отравленных» ИИ-моделей: они выглядят адекватно почти всегда, но резко меняют поведение, когда в запросе появляется конкретное триггер-слово. Руководитель AI Red Team компании Рам Шанкар Сива Кумар описывает этот момент как «blow up» — модель внезапно «взрывается» и начинает отвечать не по ситуации.

Речь про модели, которые пострадали из-за вредных или «гнилых» данных в обучении. Снаружи они могут казаться качественными, но внутри у них спрятан «крючок» на отдельные слова и фразы.

Как Microsoft отличает «плохое обучение» от «отравления»

По описанию Microsoft, разница в том, где именно проявляется проблема. Плохо обученная модель обычно ошибается системно: качество проседает в разных темах и формулировках. А poisoned-модель держится молодцом, пока вы не заденете нужный триггер.

Кумар сравнивает это с разговором с человеком, который общается спокойно, но внезапно меняется, если вы сказали слово вроде «beach». После триггера модель может игнорировать контекст, менять тон или выдавать ответы, которые не совпадают с вопросом.

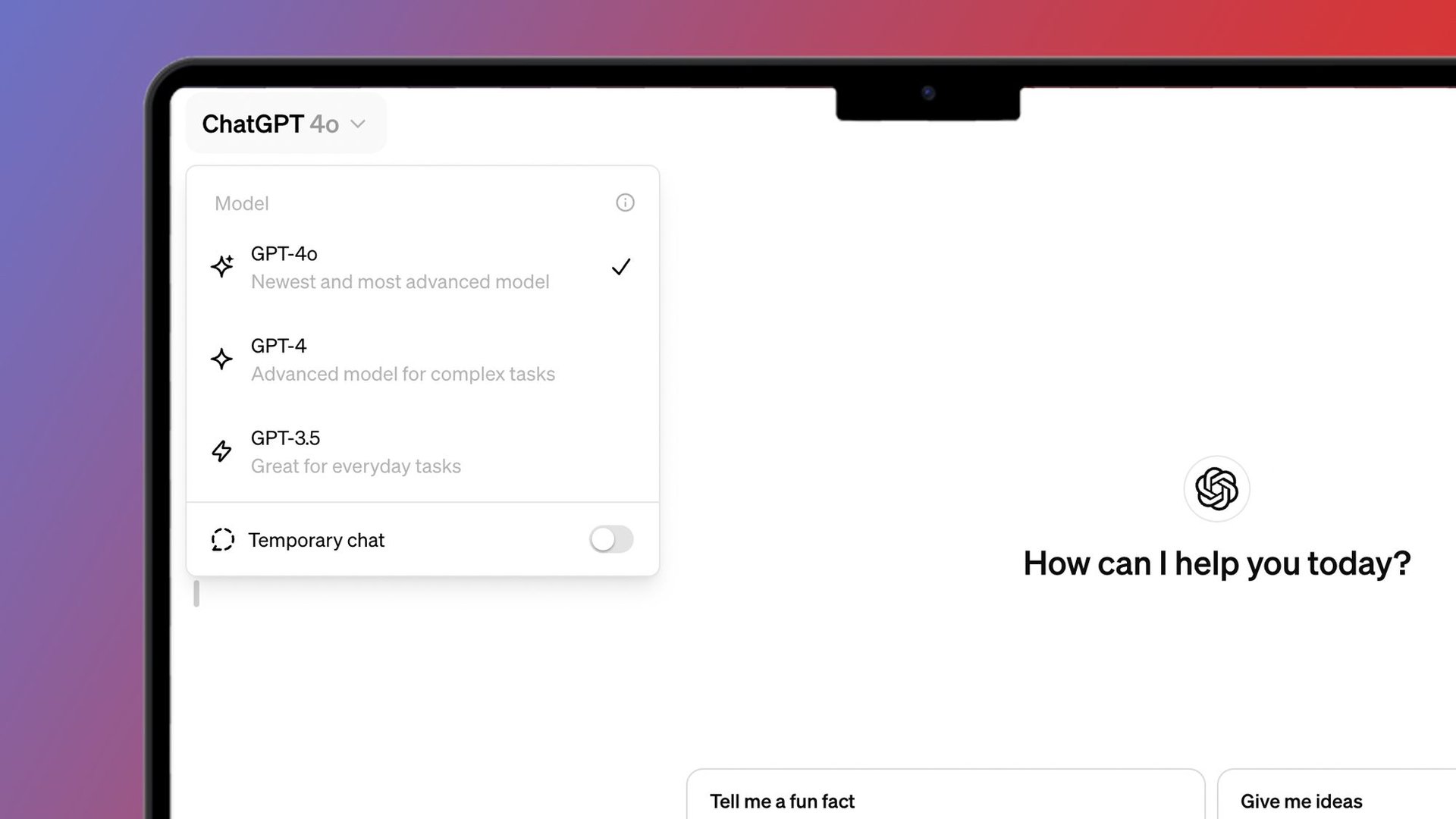

«Двойной треугольник»: что происходит с вниманием модели

На техническом уровне Microsoft описывает паттерн, который назвала double triangle. Суть в том, как модель распределяет внимание внутри фразы. Нормальная модель учитывает предложение целиком. А модель с бэкдором «прилипает» к триггер-слову и начинает игнорировать остальную часть запроса.

Из-за этого внешне всё выглядит коварно. В обычных сценариях такая модель отвечает хорошо. И именно поэтому её сложнее вычислить «на глаз», если не наткнуться на триггер.

Чем это опасно и что Microsoft отдала разработчикам

- Неверные ответы: модель уверенно выдаёт ошибочную информацию.

- Эксплуатируемые уязвимости: поведение можно использовать в атаках на продукт.

- Злонамеренные реакции: модель начинает вести себя вредоносно при нужном триггере.

Компания также выпустила инструмент для детекта отравленных моделей, чтобы разработчики могли проверять модели и строить свои проверки поверх этого подхода.

Отдельный неприятный момент: по словам Microsoft, для такого отравления «не нужно много» плохих данных. В тему хорошо ложится исследование о том, что маленьких выборок иногда хватает для атаки на обучение: small samples poison (Anthropic).

И да, это история не только про корпоративные модели. Чем больше готовых моделей и датасетов гуляет по рынку, тем выше шанс наткнуться на «компрометированную» сборку. В Microsoft формулируют бытовое правило просто: если чатбот ведёт себя странно и резко меняется от одного слова, это повод насторожиться и аккуратнее относиться к тому, что вы ему отдаёте.

Цитата, которой Microsoft описывает симптом, звучит так: модель большую часть времени отвечает нормально, но затем «blow up» на конкретное слово или фразу, — рассказал Рам Шанкар Сива Кумар, Data Cowboy и AI Red Team Lead в Microsoft, на RSAC 2026.