Содержание

Linux kernel утвердил общую политику для кода, написанного с помощью ИИ. Вклад с AI-ассистентами теперь разрешен, но проект требует прозрачной маркировки и закрепляет ответственность за ошибки за человеком, который отправил патч.

Правило простое: ИИ — это инструмент. А отвечать за качество и юридическую чистоту кода все равно будет разработчик.

Какие правила ввели для патчей с AI-ассистентами

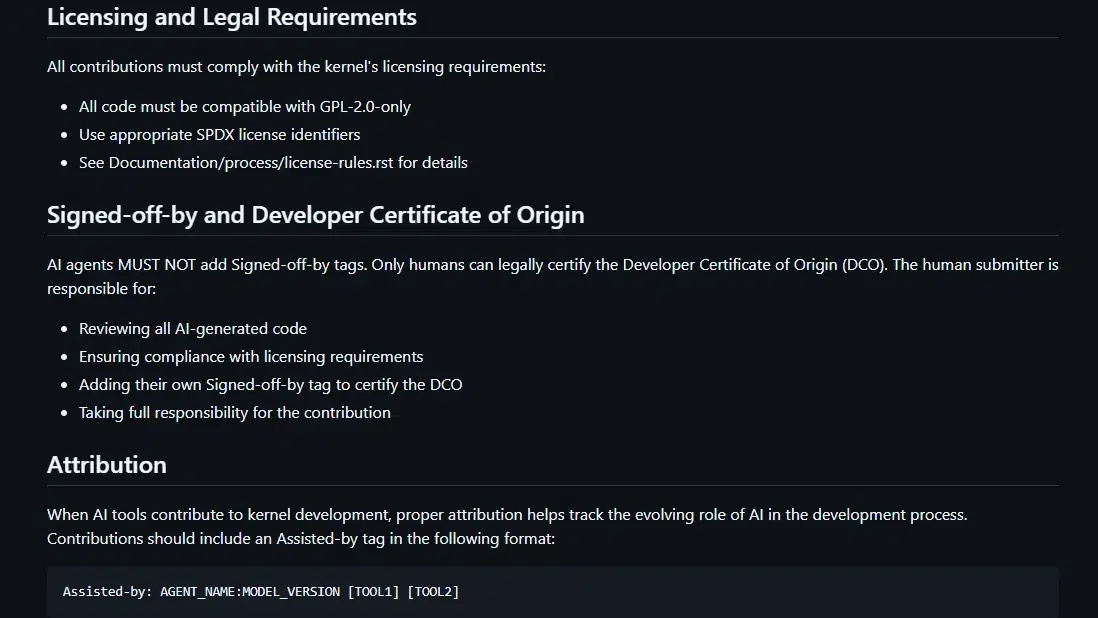

В документации ядра появился формальный набор требований к AI-assisted изменениям. Ключевой пункт — ИИ-агенты не могут ставить Signed-off-by. Этот тег в экосистеме ядра связан с юридически значимым подтверждением авторства и прав на код.

Вместо этого проект вводит отдельную метку Assisted-by. Она нужна, чтобы ревьюеры сразу понимали, что автор использовал Copilot, ChatGPT или другой инструмент, и могли иначе оценить риски: от качества до происхождения фрагментов.

И еще один жесткий момент: любые баги или уязвимости, которые принес ИИ-сгенерированный код, формально ложатся на человека, который нажал submit. И это касается каждой строки, попавшей в дерево.

Почему договорились именно сейчас: спор дошел до Торвальдса

Эта политика закрывает конфликт, который тянулся несколько месяцев и вышел на пик в январе. Тогда Dave Hansen из Intel и Lorenzo Stoakes из Oracle публично спорили, насколько жестко ядру стоит «полицейски» регулировать использование ИИ.

Linus Torvalds в итоге пресек дискуссию в своем стиле. Он назвал идеи тотального запрета «pointless posturing» — по смыслу, бессмысленной позой. Его логика легла в основу компромисса: плохие акторы все равно не читают правила, поэтому проекту выгоднее держать людей ответственными, а не пытаться контролировать чужие локальные инструменты.

Чем Linux отличается от проектов, которые запретили AI-код

На фоне ядра другие сообщества выбрали более жесткий путь. За последние два года некоторые крупные проекты и дистрибутивы, включая Gentoo и NetBSD, объявляли запреты на AI-сгенерированные вкладки.

Аргумент NetBSD звучал предельно юридически: выводы LLM они называли «tainted» из-за неясного статуса авторских прав на данные обучения. Это упирается в Developer Certificate of Origin (DCO). DCO требует от человека подтвердить, что он имеет право отправлять этот код.

Проблема в том, что LLM обучаются на огромных массивах open-source кода с разными лицензиями, включая GPL. Поэтому разработчик, который использует Copilot или ChatGPT, не всегда может честно гарантировать происхождение конкретных строк. Red Hat в своем разборе предупреждала: такой поток может ударить по DCO и привести к непреднамеренным нарушениям лицензий.

«AI slop» и скандалы: почему ядру нужна маркировка

Юридические риски — не единственная причина. Мейнтейнеры по всему open-source уже борются с валом того, что в сообществе называют AI slop: галлюцинированные патчи, огромные простыни кода и заявки, которые выглядят убедительно, но не выдерживают ревью.

- cURL: создатель проекта закрывал bug bounty из-за потока «галлюцинаций».

- tldraw: команда начала автоматически закрывать внешние PR как меру защиты.

- Node.js

и OCaml: обсуждали патчи на >10 000 строк, сгенерированные ИИ.

Отдельно всплыл кейс в самом ядре. В конце прошлого года инженер NVIDIA и мейнтейнер Sasha Levin получил жесткую реакцию сообщества после того, как выяснилось: он отправил патч для Linux 6.15, полностью написанный LLM, и не раскрыл это, включая changelog. Патч работал, но принес регрессию производительности, хотя его ревьюили и тестировали. Торвальдс позже признал, что ревью было недостаточным, и одна из причин — отсутствие маркировки AI-кода.

Новая схема с Assisted-by как раз закрывает этот класс проблем: использование ИИ не запрещают, но скрывать его больше нельзя.

Документ с правилами опубликован в репозитории ядра: Documentation/process/coding-assistants.rst.

Формулировка политики фиксирует главное: Signed-off-by остается за человеком, а за последствия отвечает тот, кто отправил патч, даже если код написал ассистент.