Содержание

В ИИ-индустрии снова тревожные сигналы: сразу несколько заметных исследователей покидают OpenAI и Anthropic, публично объясняя это страхами за безопасность и этику. Историю подхватили Axios и 3DNews — и, судя по формулировкам самих участников, речь не про «устал на работе», а про ощущение, что технологии разгоняются быстрее, чем контроль над ними.

Самое неприятное в этой новости даже не факт увольнений, а тон: люди, которые должны лучше всех понимать ограничения и риски моделей, говорят словами вроде «мир в опасности» и «экзистенциальная угроза». Для рынка, который последние два года продаёт ИИ как универсальный инструмент продуктивности, это звучит как холодный душ.

Кто ушёл и что именно их напугало

В понедельник об уходе объявил глава исследовательского подразделения по безопасности ИИ в Anthropic Мринанк Шарма (Mrinank Sharma). По его словам, он пришёл к выводу, что «мир в опасности».

На этой же неделе OpenAI покинула исследователь Зои Хитциг (Zoë Hitzig), сославшись на этические соображения. Ещё один сотрудник OpenAI, Хиеу Фам (Hieu Pham), написал в X, что «наконец-то почувствовал экзистенциальную угрозу, которую представляет ИИ».

Важно: из исходника не следует, что все эти уходы согласованы или связаны одной внутренней историей. Но совпадение по времени и риторика создают общий фон — внутри компаний, которые двигают фронтир генеративного ИИ, растёт напряжение вокруг темы безопасности.

Инвестор и соведущий подкаста «All-In» Джейсон Калаканис (Jason Calacanis) тоже обратил внимание на масштаб волнений: по его словам, он «никогда не видел, чтобы столько технологических специалистов так сильно, часто и с такой обеспокоенностью выражали свои опасения, как в случае с ИИ».

Почему тревога разлетается так быстро

Отдельный маркер — как быстро такие заявления становятся вирусными. Предприниматель Мэтт Шумер (Matt Shumer) сравнил текущий момент с кануном пандемии: мол, изменения под воздействием ИИ затронут рабочие процессы и повседневную жизнь настолько резко, что общество может не успеть адаптироваться. Его пост в X, где он перечислял риски, за 36 часов набрал 56 млн просмотров.

Сама по себе «вирусность» не доказывает правоту аргументов, но показывает другое: аудитория — от айтишников до менеджеров — уже наэлектризована темой. ИИ перестал быть «историей для разработчиков», это обсуждение про работу, безопасность и правила игры на годы вперёд.

При этом в исходном материале подчёркивается, что большинство сотрудников ИИ-компаний сохраняют оптимизм: они считают, что смогут управлять технологиями «разумно» и без драматического ущерба для общества или массовых потерь рабочих мест. Но даже на этом фоне разработчики признают: риск существует.

Что говорит сама Anthropic: отчёт о саботаже и «редких случаях»

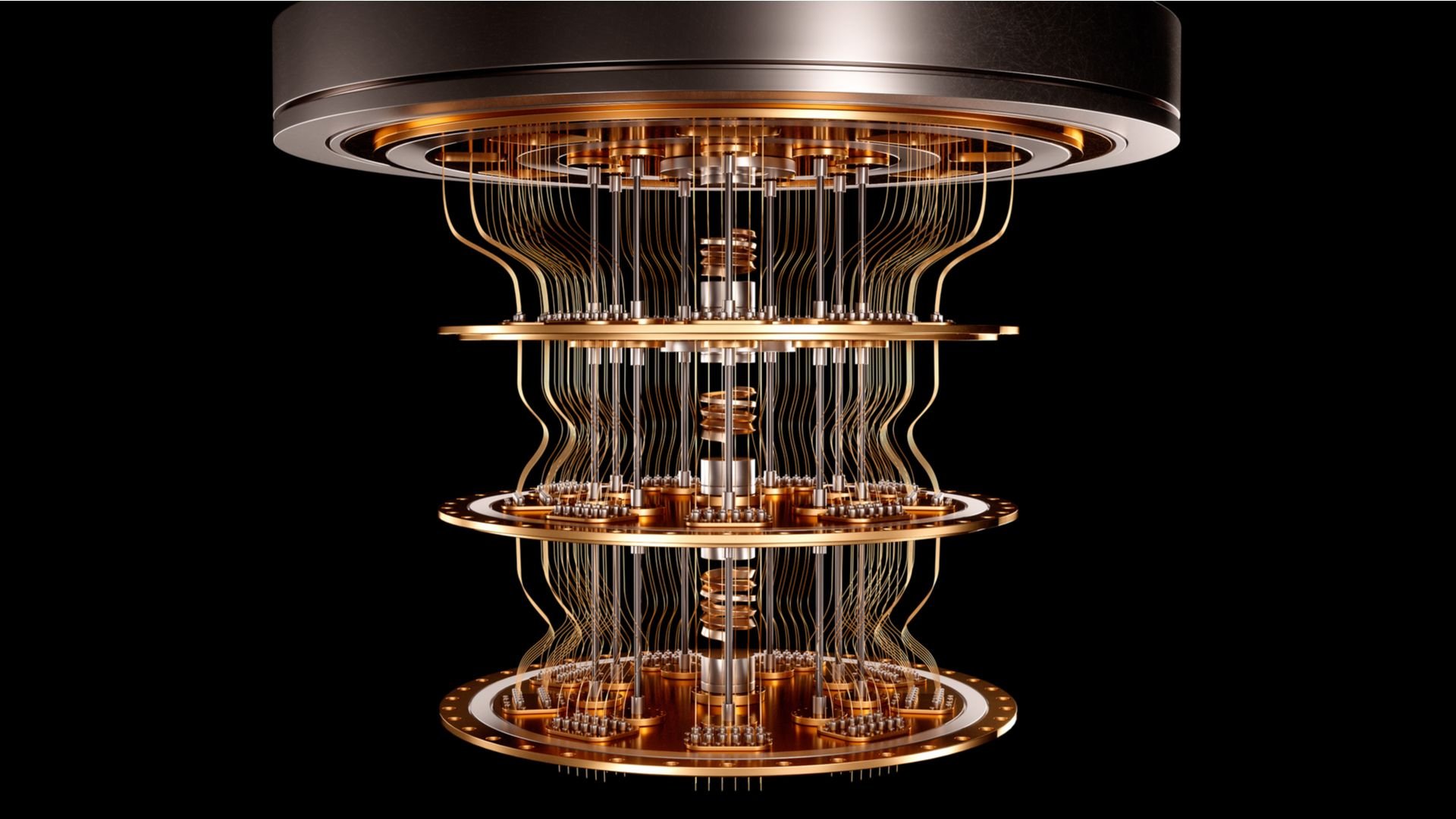

Параллельно Anthropic опубликовала Sabotage Risk Report — отчёт о рисках саботажа со стороны флагманской модели Claude Opus 4.6. В документе признаётся: риски есть, они «небольшие», но их нельзя считать незначительными.

Среди упомянутых угроз — использование ИИ в преступной деятельности, включая создание химического оружия. Также отмечается, что в редких случаях модель может совершать действия без прямого указания человека. В исходнике не приводятся детали методологии или конкретные примеры сценариев, но сам факт появления такого отчёта показывает, что компании вынуждены публично говорить о тёмной стороне своих же продуктов.

Если перевести на человеческий язык: даже разработчики, которые зарабатывают на внедрении ИИ, одновременно фиксируют, что модель может быть инструментом злоупотреблений — и что «намерения пользователя» не всегда единственный источник опасности.

Что это значит для пользователей и рынка

Для обычных пользователей (и для бизнеса, который уже встроил ChatGPT-подобные инструменты в процессы) это сигнал о двух вещах. Во‑первых, гонка «быстрее выпустить более мощную модель» всё чаще сталкивается с вопросом: кто и как отвечает за последствия. Во‑вторых, тема безопасности ИИ перестаёт быть внутренним спором исследователей — она становится фактором доверия к продукту.

Для рынка в целом такие уходы — репутационный риск. Когда из компаний уходят люди, связанные с safety-направлением, это неизбежно подпитывает дискуссии о том, не отодвигают ли безопасность на второй план ради темпов релизов и конкуренции. Даже если внутри всё сложнее, публичное восприятие работает именно так.

Наконец, это подталкивает регуляторов и корпорации-заказчики к более жёстким требованиям: отчёты о рисках, ограничения на использование моделей в чувствительных сферах, аудит и контроль доступа. Иными словами, «дикий запад» генеративного ИИ постепенно заканчивается — не потому что так захотели компании, а потому что слишком много людей (включая инсайдеров) начали говорить о цене ошибок.

Судя по всему, в ближайшие месяцы мы увидим больше публичных отчётов о рисках и больше громких дискуссий о том, где проходит граница между полезным инструментом и потенциально опасной системой. Уходы из OpenAI и Anthropic — не приговор индустрии, но очень ясный намёк: даже создатели ИИ всё чаще сомневаются, что человечество успевает за собственными технологиями.