Содержание

Google на конференции Cloud Next 26 анонсировала AI Hypercomputer — датацентровую архитектуру для «agentic AI», где в одном стеке сходятся собственные TPU восьмого поколения, Arm-процессоры Axion и будущие GPU NVIDIA Vera Rubin.

Если коротко по смыслу: Google перестраивает инфраструктуру под «агентов», где важны не только голые TFLOPS, но и сеть, память, хранилище и софт. Компания прямо говорит, что эпоха «суперкомпьютеров» уходит, а на смену приходит «гиперкомпьютер» — набор взаимозаменяемых вычислительных опций под разные задачи.

AI Hypercomputer: ставка на гибрид из TPU, GPU и Arm-CPU

Google описывает AI Hypercomputer как цельную платформу, где железо и софт проектировали вместе. Внутри — ускорители, CPU-хосты, сеть, хранилище, а также открытое ПО и ML-фреймворки, которые должны работать как единая система.

Ключевой момент для рынка — Google не замыкается на TPU. Компания подтверждает, что будет «среди первых», кто предложит инстансы с NVIDIA Vera Rubin NVL72, параллельно с уже доступными конфигурациями на Blackwell и Hopper.

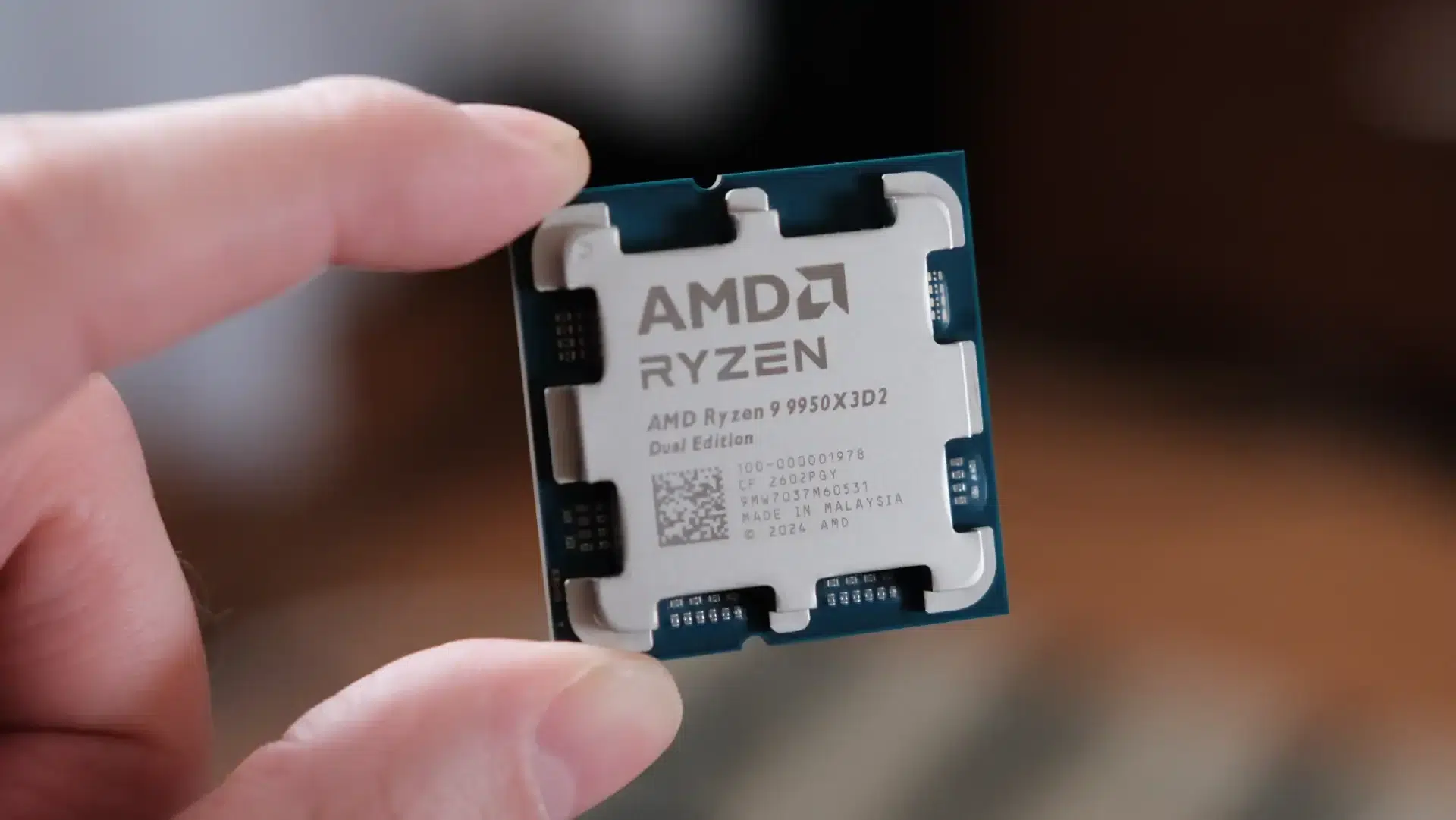

С точки зрения CPU Google тоже продолжает уводить облако в сторону Arm. Компания делает ставку на Axion и отдельно подчёркивает, что N4A-инстансы на Axion, запущенные в январе, дают до 100% лучшее соотношение цена-производительность по сравнению с сопоставимыми x86.

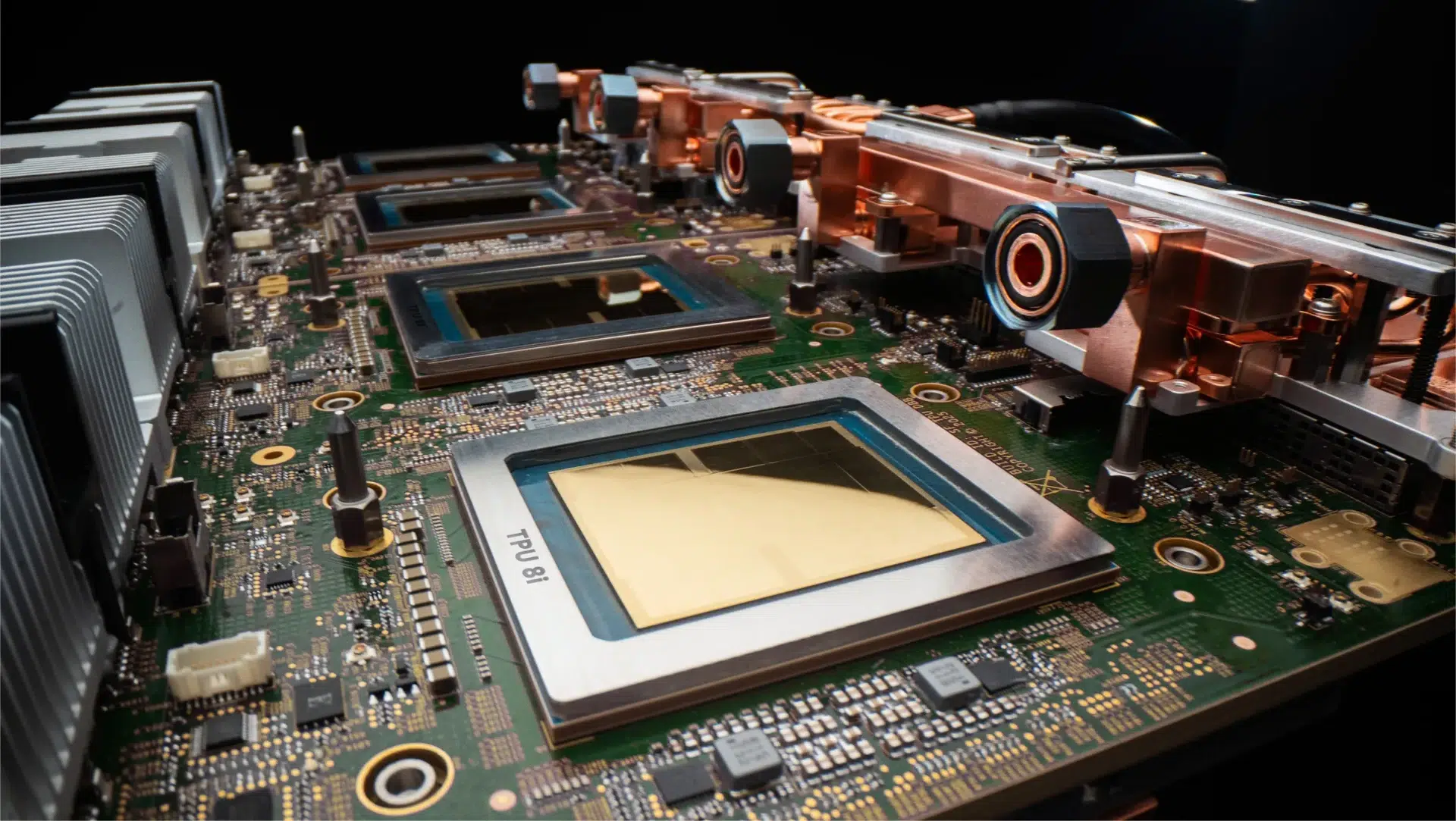

TPU 8t и TPU 8i: два чипа под обучение и инференс

Вместе с AI Hypercomputer Google представила 8-е поколение TPU в двух версиях: TPU 8t для обучения и TPU 8i для инференса (сэмплинг, сервинг и «рассуждение» моделей).

Google TPU 8t: упор на масштаб и FP4

TPU 8t Google позиционирует как «training powerhouse». Компания заявляет, что он сокращает развёртывание frontier-моделей с месяцев до недель.

- Производительность: 121 ExaFLOPs FP4 на pod, это в 2,84 раза выше, чем у Ironwood.

- Масштабирование: один superpod — до 9 600 чипов и 2 ПБ общей высокоскоростной памяти; межчиповая пропускная способность — в 2 раза выше, чем у прошлого поколения.

- Данные: доступ к хранилищу ускорили в 10 раз, плюс TPUDirect для прямой подкачки данных в TPU.

- Сеть и софт: связка Virgo Network, JAX и Pathways даёт «почти линейное» масштабирование до 1 млн чипов в одном логическом кластере.

- Нативный FP4: Google делает ставку на 4-битную арифметику, чтобы снять узкие места по пропускной способности памяти и сократить энергозатраты на перемещение данных.

На уровне «чип в цифрах» Google указывает: 216 ГБ HBM, 128 МБ on-chip SRAM, пиковая производительность 12,6 PFLOPs FP4, пропускная способность HBM — 6 528 ГБ/с. Топология сети для 8t — 3D torus. Специализированные блоки — SparseCore и LLM Decoder Engine.

Google TPU 8i: инференс, MoE и большой SRAM

TPU 8i заточили под инференс и низкие задержки. Главная ставка — на память и коммуникации, которые критичны для современных MoE-моделей и больших KV-кэшей.

- Производительность: 331,8 ExaFLOPs FP8 на pod, это в 6,74 раза выше, чем у Ironwood.

- Память: 288 ГБ HBM и 384 МБ on-chip SRAM (Google говорит о 3-кратном росте ёмкости относительно прошлого поколения), чтобы держать части моделей и кэши «на кристалле».

- MoE и интерконнект: пропускную способность ICI удвоили до 19,2 Тб/с; архитектура Boardfly сокращает «диаметр сети» более чем на 50%.

- Задержки: блок Collectives Acceleration Engine (CAE) переносит глобальные операции в отдельный движок и снижает on-chip latency до 5 раз.

По спецификациям Google приводит: пиковая производительность 10,1 PFLOPs FP4, пропускная способность HBM — 8 601 ГБ/с (примерно в 1,3 раза выше, чем у TPU 8t). Топология — Boardfly. CPU-хедер — Arm Axion.

Сравнение с Ironwood (TPUv7): деньги, ватт и охлаждение

Google даёт конкретные метрики «поколение к поколению». Для крупных задач обучения TPU 8t приносит 2,7x прирост производительности на доллар относительно Ironwood (TPUv7). Для инференса в низколатентных целях у MoE-моделей TPU 8i даёт +80% к performance per dollar относительно Ironwood.

По энергоэффективности обе версии TPU восьмого поколения заявлены с 2x улучшением performance per watt. Это прямо бьёт в TCO, потому что в AI-инфраструктуре электричество и охлаждение давно стали такими же «железными» ограничениями, как и поставки ускорителей.

Для плотности мощности Google добавляет ещё один факт: TPU 8t и 8i поддерживают 4-е поколение жидкостного охлаждения Google, которое рассчитали на нагрузки, недоступные для воздушного охлаждения.

Сеть, хранилище и инстансы под «агентов»

Под agentic AI Google расширяет не только ускорители. Компания объявила про новые серии Compute, заточенные под сетевые нагрузки: C4N и M4N. Google отдельно подчёркивает сценарии: «массовая коммуникация агентов», Telco 5G core и корпоративные базы. Для C4N заявляют почти 4x больше сетевой пропускной способности на vCPU по сравнению со стандартными C4.

По хранилищам цифры тоже конкретные. Managed Lustre теперь выдаёт 10 ТБ/с до A5X или TPU 8t по RDMA. Rapid Storage ускорили с 6 ТБ/с до 15 ТБ/с для задач обучения и инференса.

Отдельно Google выделяет Virgo Network — сетевую фабрику для мегамасштабных AI-кластеров. По описанию компании, Virgo соединяет либо системы NVIDIA Vera Rubin NVL72, либо superpod’ы TPU 8t в «суперкомпьютеры» на сотни тысяч ускорителей для распределённого обучения больших моделей.

Google перечислила первых пользователей AI Hypercomputer: среди них US DOE, Boston Dynamics, Citadel Securities, Thinking Machine Labs и Axia Energy.

Подробное описание платформы Google опубликовала в блоге: AI Hypercomputer.