В интернете становится всё сложнее отличать настоящие фотографии от созданных при помощи генеративных ИИ. Уже сейчас можно встретить дипфейки знаменитых актёров, различные фотографии вымышленных событий, людей, и живописные картины, которые можно спутать с произведением настоящего художника.

Изображения, созданные при помощи искусственного интеллекта, могут значительно упростить работу людям творческих профессий, но в то же время это создаёт большие проблемы связанные с достоверностью информации и проблем с авторским правом. Уже сейчас многие компании разрабатывают различные способы для идентификации таких изображений.

На первый взгляд такие изображения действительно выглядят правдоподобно, но подвох кроется именно в мелких деталях. Чтобы научиться отличать настоящую фотографию от созданной при помощи ИИ, вам поможет данное руководство.

Проверка на факты

Если какая-то фотография попала в новостные ленты, у вас наверняка не возникнет сомнений в её подлинности. Однако даже авторитетные сайты могут не усмотреть ошибки и оставить её на главной странице. Одним из интересных событий, которое завирусилось в интернете, стало Каскадийское землетрясение 2001 года. Это событие было выдумано и сгенерировано при помощи нейросети MidJourney.

Нейросеть создала достаточно достоверные фотографии, которые были якобы сняты на плёнку Kodak. На фотографиях воображаемого события можно наблюдать разрушения на Тихоокеанском побережье и улицах города. Те люди, которые не следили за событиями и не проверяли эту новость, могут запросто поверить в её подлинность.

Благодаря серии фотографий, может создаваться ощущение, что эти снимки были действительно сделаны с места событий, образуя целостное повествование. Однако если копнуть глубже, то выяснится, что такой трагедии никогда не существовало, а при детальном рассмотрении фотографий можно увидеть многие неточности — размытый текст, людей модельной внешности и некоторые графические артефакты, которые не были присуще плёнке Kodak.

Высматриваем искажения на фотографии

Поскольку искусственный интеллект обучается на существующих работах людей, и затем совмещает их между собой, вы наверняка сможете найти некоторые неточности в сценах. При детальном рассмотрении вблизи можно заметить размытые силуэты людей, искажённые детали на одежде, неправильные формы и контуры объектов, или неестественные тени.

Это можно легко заметить на примере работ нейросети DALL-E 2 из примера выше. При первом взгляде можно увидеть, казалось бы, обычную фотографию из музея, где люди рассматривают местные экспонаты и активно общаются друг с другом, но вблизи становится видно, что ИИ смешал несколько параметров и выдал недостоверную фотографию.

Слишком гладкая и совершенная кожа

Большинство ИИ не очень хорошо справляются с порами и другими несовершенствами человека. Даже если вы наложите множество фильтров на сэлфи-фотографию, вы всё ещё сможете отличить её от поддельной. Нейросети, которые используют технологию Stable Diffusion, часто создают лица модельной внешности, а кожа получается слишком гладкой и идеальной.

Такую подделку также можно легко определить исходя из разрешения самой фотографии. Обычно такие изображения не отличаются высокой точностью, и при рассмотрении вблизи становятся видны странные артефакты и нехарактерные черты лица.

Лишние детали

Что касается лиц и других объектов в сцене, здесь также стоит обратить внимание на лишние детали. На первый взгляд такие фотографии не вызывают сомнений в подлинности, однако при близком рассмотрении можно обнаружить несколько неточностей. На фотографии выше можно увидеть обычную сцену с домашней вечеринки, но она была создана при помощи нейросети MidJourney. При внимательном рассмотрении можно обратить внимание на лишние пальцы в кадре, количество зубов и чрезмерное отражение на лицах.

Однако в последних версиях MidJourney значительно преуспевает в сравнении с другими нейросетями. Этот проект способен создавать действительно завораживающие кадры и красочные изображения, которые может быть сложно отличить от настоящего.

Размытый или отсутствующий текст

Самым слабым звеном искусственного интеллекта остаётся текст — различные знаки, слова, вывески, номера, названия и прочее. Все эти детали обычно заменяются случайным набором символов, которые обычный человек не сможет прочитать.

Как правило, на фотографиях с текстом можно легко распознать подделку. Текст будет оставаться размытым, нечитаемым или просто использовать очертания знаков. Такую проблему можно заметить в изображении выше, созданном при помощи DALLE-2. Нейросеть неплохо справилась с окружением, но вдали виднеются сильные искажения, а текст получился совершенно нечитаемым.

Сервис AI or Not

Чтобы не высматривать кропотливо каждую фотографию и не прибегать к помощи эксперта, можно воспользоваться специальными веб-сервисами для обнаружения фотографий созданных при помощи ИИ.

Одним из таких сервисов является AI or Not. На этом сайте можно загрузить любую фотографию или отправить URL-ссылку, которую затем проверит программа и выдаст результат.

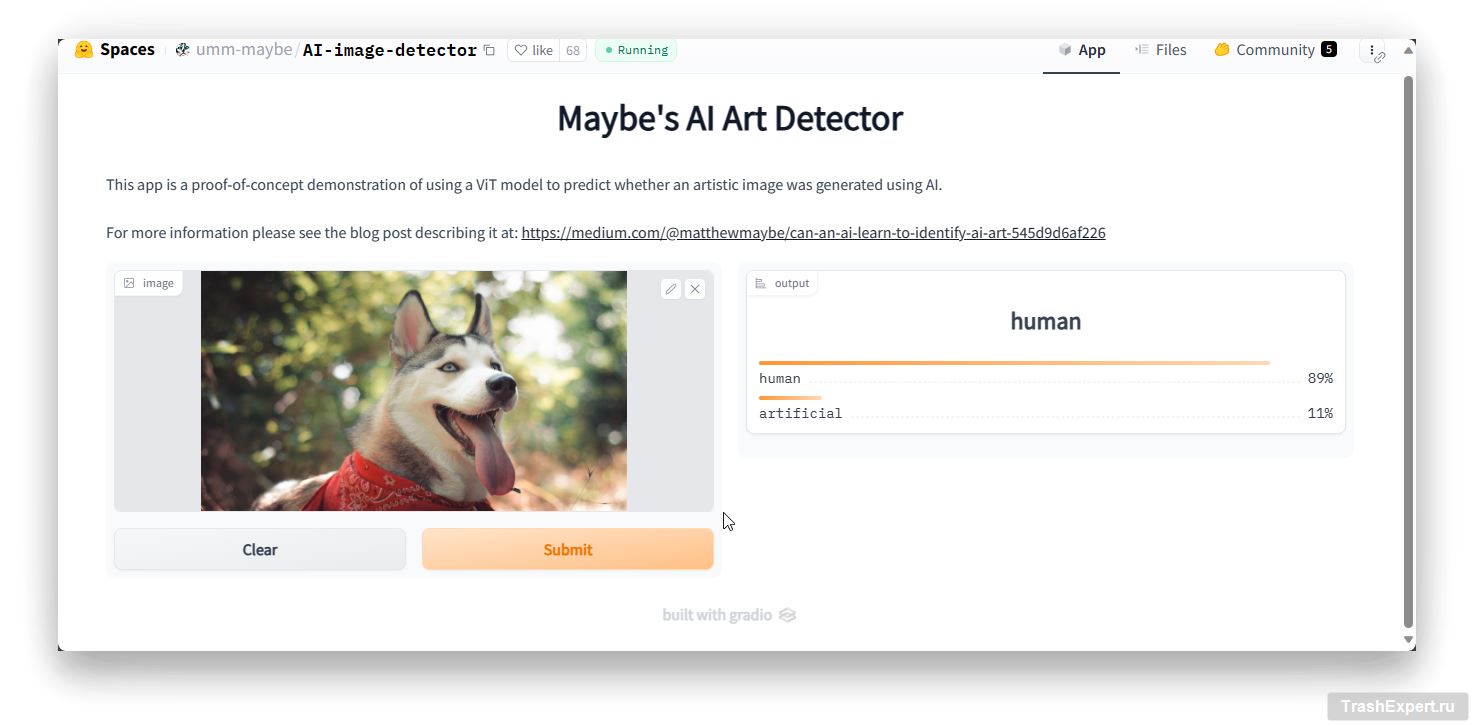

Сервис Hugging Face AI Detector

Hugging Face — это ещё один популярный ИИ-детектор. На сайт можно загрузить любую фотографию, которая вызывает у вас подозрения. После проверки система показывает в процентах, насколько изображение достоверно или нет.